Matrix‑Game 3.0 是一個基於 Diffusion Transformer(DiT)的記憶增強世界模型,目標是做 720p 解析度、可達 40 FPS 的實時長序列互動視訊生成,用於第一人稱、第三人稱等遊戲/虛擬世界場景。它能根據滑鼠+鍵盤輸入一邊生成新畫面,一邊維持場景長時間的一致性(例如分鐘級序列),並可擴展到 2×14B 甚至 28B MoE 規模。

三大技術層面

- Data Engine

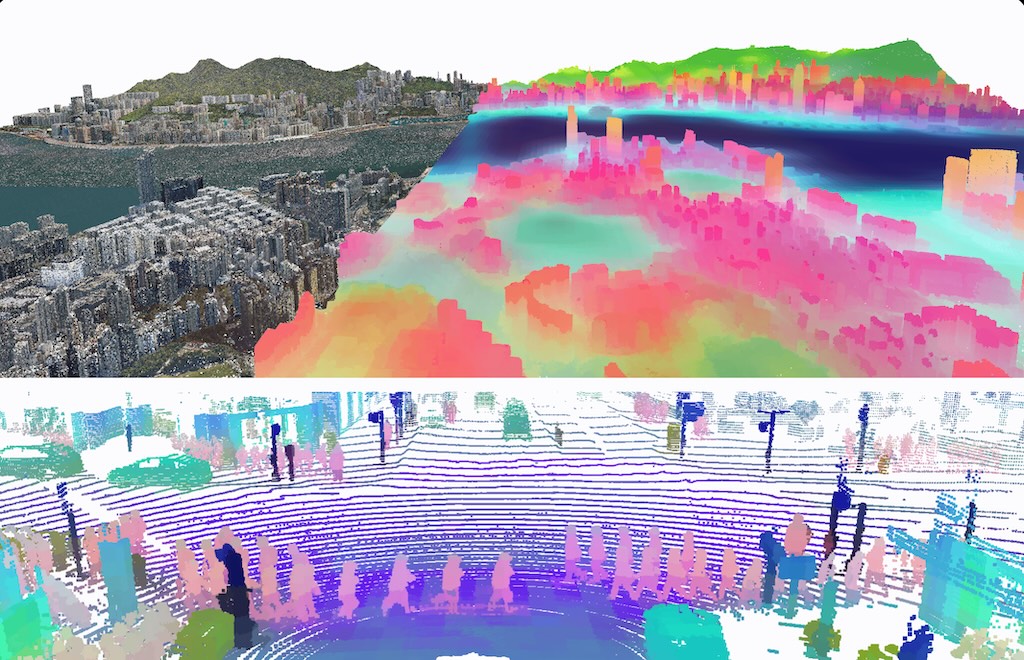

- 用 Unreal Engine 生成合成資料,加上對 AAA 遊戲的大規模自動錄製、與真實影片資料增強,產出高品質的 Video–Pose–Action–Prompt 四元資料。

- 這種「工業級無限資料機器」讓模型能學習大量互動式行為與視角變化。

- 記憶增強模型(Memory‑augmented DiT)

- 高效實時推論(Distillation + Quantization)