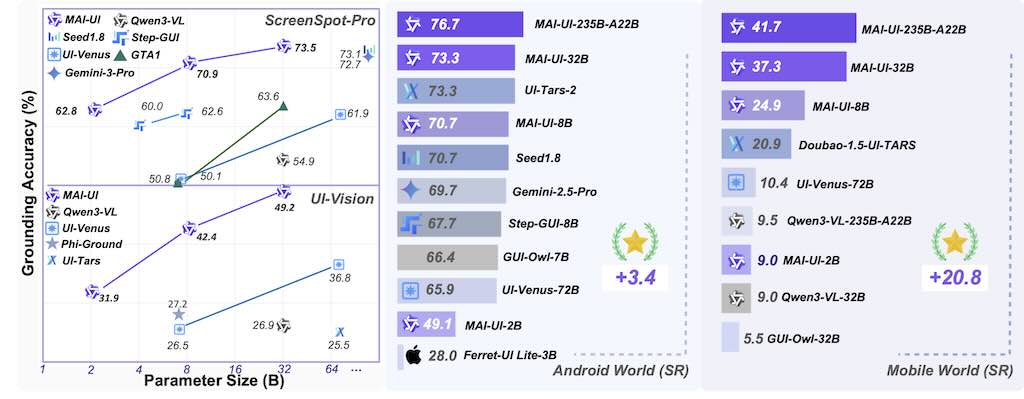

Qwen3.6-Plus 顯著增強了模型的智能體(Agent)編程能力。無論是前端網頁開發,還是複雜的代碼倉庫級問題求解,Qwen3.6-Plus 均樹立了全新的業界標桿(SOTA)。此外,Qwen3.6-Plus 對世界的感知更加精准,多模態推理能力也更為敏銳。本次發佈直接回應了社區在 Qwen3.5-Plus 部署期間反饋的意見,為開發者生態提供了高度穩定可靠的基礎,帶來真正具有變革意義的“氛圍編程”(Vibe Coding)體驗。

官方已提供 OpenClaw 整合,編輯 ~/.openclaw/openclaw.json

{

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://dashscope.aliyuncs.com/compatible-mode/v1",

"apiKey": "DASHSCOPE_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.6-plus",

"name": "qwen3.6-plus",

"reasoning": true,

"input": ["text", "image"],

"contextWindow": 1000000,

"maxTokens": 65536

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.6-plus"

},

"models": {

"bailian/qwen3.6-plus": {}

}

}

}

}