Brain-IT-VQA 是一套從 fMRI(功能性磁共振造影)腦部訊號出發,自動回答「圖片中看到什麼」這類問題的框架。研究團隊建基於 Brain Interaction Transformer(Brain-IT),把腦部活動轉換成語言條件表徵,再交由預訓練的視覺語言模型生成答案,全程毋須先把腦部訊號重建成影像。

這項工作解決了一個長期難題:過去從 fMRI 解讀視覺內容的研究,大多只能產生粗略描述,而且準確度有限;更少有模型被用來分析大腦內部如何處理視覺資訊。Brain-IT-VQA 在多項基準上明顯超越以往的 fMRI 影像描述與 VQA(Visual Question Answering,視覺問答)方法,同時提供拆解視覺理解層次的工具。

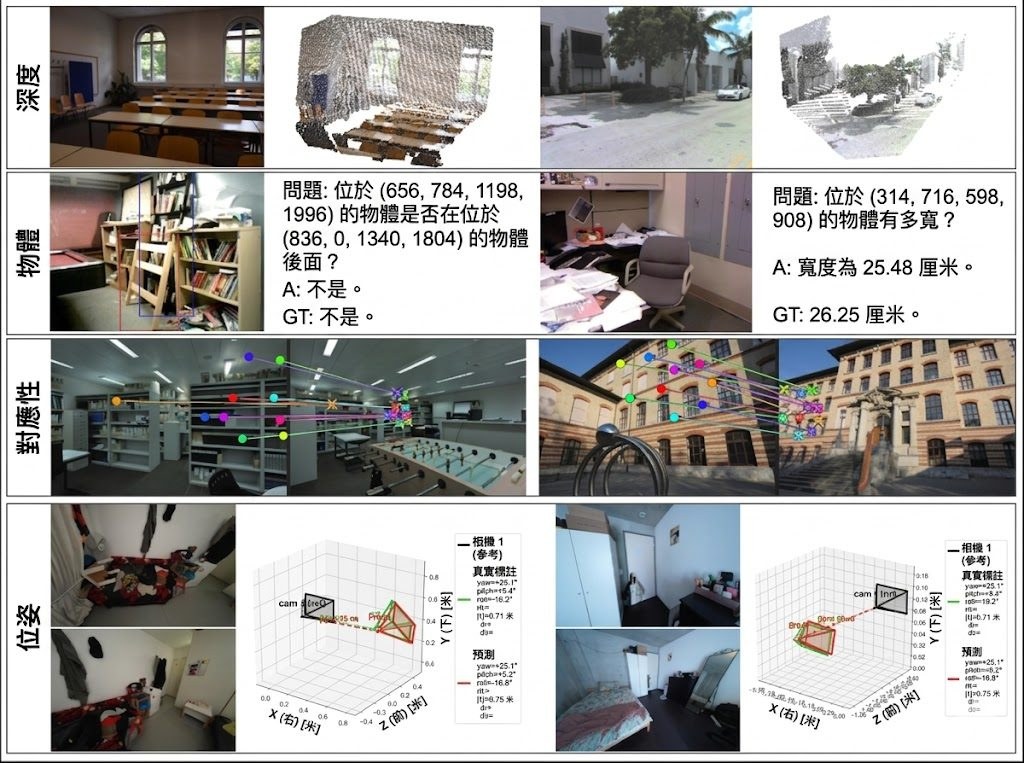

團隊同步發佈 NSD-VQA 數據集,以 Natural Scenes Dataset(NSD)為基礎,平均每張影像提供約 20 題,涵蓋 20 個受控問題類別。這些類別覆蓋物件辨識、空間關係、語意判斷等不同層次,方便研究者細緻評估模型在各種視覺與語意任務上的表現。

透過「解碼貢獻分析」,框架可揭示不同腦區對各類問題的貢獻分布,協助神經科學家理解大腦處理視覺資訊的空間分佈特徵。頁面亦設有互動示範,讓訪客在從未參與訓練的 NSD 測試影像上,瀏覽模型生成的描述與問答結果。

重點摘要

- 直接從 fMRI 解碼語言:把腦部活動轉成語言條件表徵,由預訓練視覺語言模型生成描述與答案,毋須影像重建步驟。

- 公開 NSD-VQA 數據集:每張影像平均 20 題、20 個受控類別,提供更細緻的 VQA 評估基準。

- 顯著超越先前方法:在 fMRI 影像描述與視覺問答任務上,明顯優於過往同類模型。

- 支援腦區貢獻分析:可拆解不同腦區在各類視覺問題中的參與程度,輔助神經科學研究。

- 附設互動示範:容許瀏覽者在 NSD 測試影像上查看模型的預測輸出。

這個項目最適合從事腦部解碼、視覺語言模型、神經科學與認知計算的研究人員與研究生。對希望了解 AI 與人類視覺如何結合的工程師而言,NSD-VQA 與開源代碼亦提供了一個具挑戰性的新基準。

研究單位:

Weizmann Institute of Science (魏茨曼科學研究所)在以色列的雷霍沃特(Rehovot),大約在特拉維夫以南。

魏茨曼科學研究所一般被視為世界頂尖的基礎研究機構之一;在你這次查到的資料裡,它在萊頓排名中被列到全球前十,2021 年為第 8 名。

它的重點研究領域主要集中在 生物學/生物化學、化學、物理、數學與電腦科學,也有跨學科方向。