ACE-Step v1.5 是一款開創性的開源音樂生成模型,將商業級別的品質帶到消費級硬體上,使其成為音樂創作者、製作人和愛好者的無價工具。該模型擅長快速生成高品質音樂,能夠在 A100 GPU 上於不到 2 秒內生成完整歌曲,在 RTX 3090 上則在不到 10 秒內完成。其效率和性能使廣泛的使用者群體,從業餘愛好者到專業製作人,都能利用先進的音樂生成能力,而無需依賴昂貴的商業軟體。

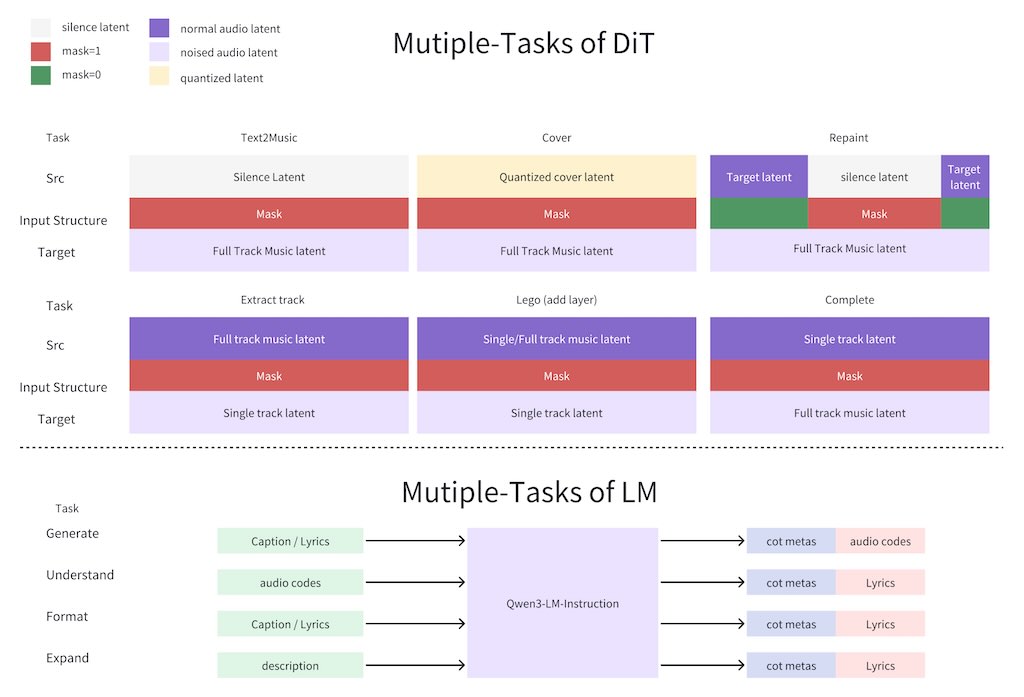

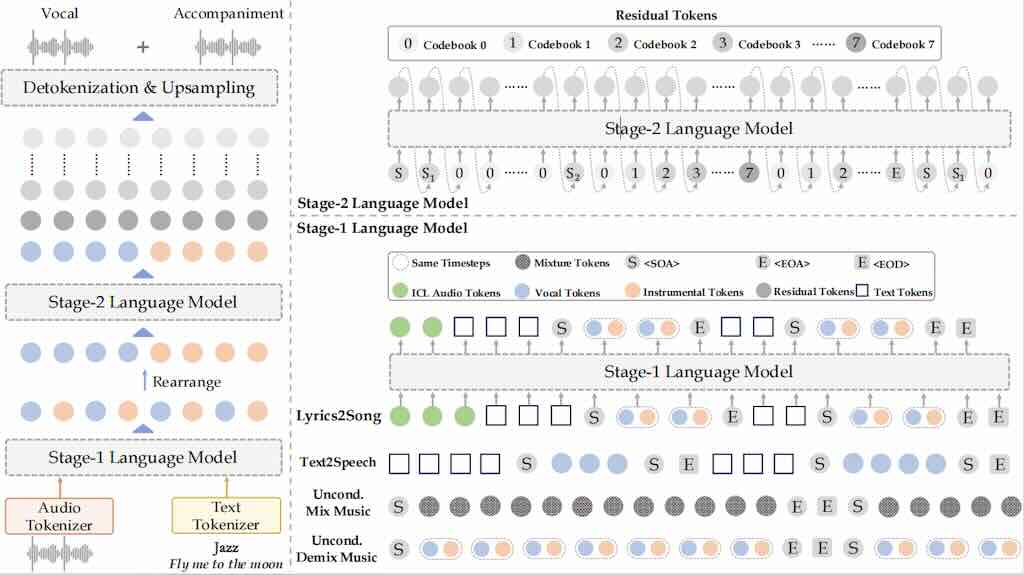

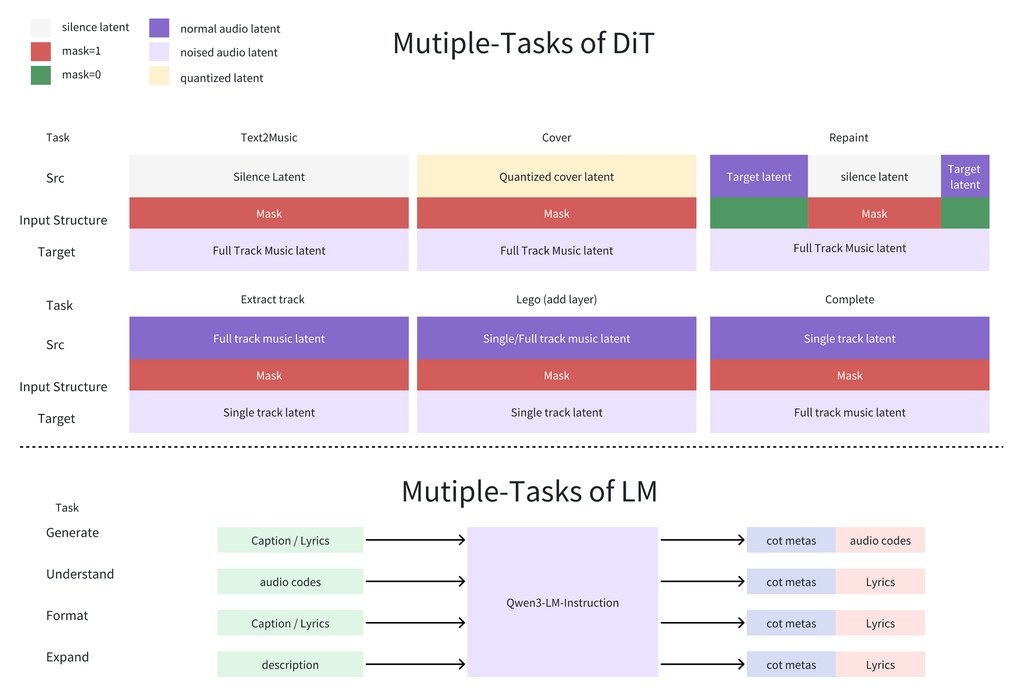

對於考慮使用 ACE-Step v1.5 的使用者,首先應關注其混合架構,該架構結合了語言模型(LM)與擴散變換器(DiT)。LM 作為規劃者,將使用者查詢轉換為全面的歌曲藍圖,而 DiT 則合成實際的音頻。這種獨特的設置允許對音樂生成過程進行精確控制,使使用者能夠創建從短循環到 10 分鐘作品的各種組成。該模型支援超過 1000 種樂器和風格,提供細緻的音色描述,以滿足多樣化的音樂偏好。

在實際應用中,ACE-Step v1.5 通過使用 LM 生成元數據、歌詞和字幕,透過鏈式思維來引導 DiT 合成音樂。這種內在的強化學習方法確保了對齊,而不受外部偏見的影響,從而生成緊密遵循使用者提示的音樂。使用者還可以透過輕量級 LoRA 訓練來個性化模型,僅需幾首歌曲即可捕捉他們獨特的風格。此功能對於希望創作出反映個人風格的藝術家特別有益。

ACE-Step v1.5 的優勢對於需要多功能和高品質音樂生成工具的音樂創作者來說最為顯著。它支援超過 50 種語言的多語言歌詞,允許全球範圍的創意表達。此外,該模型還提供各種編輯功能,如封面生成、重新繪製和人聲轉 BGM 轉換,增強了其在創意工作流程中的實用性。內容創作者、音樂製作人和藝術家可以將 ACE-Step v1.5 無縫整合到他們的專案中,從其速度、品質和靈活性中受益。

然而,也有一些權衡需要考慮。儘管 ACE-Step v1.5 高度高效,但其性能嚴重依賴於所使用的硬體。使用較弱 GPU 的使用者可能會經歷較慢的生成時間或模型大小的限制。該模型還需要至少 4GB 的 VRAM 才能本地運行,這對於某些使用者來說可能是一個限制。此外,生成的音樂品質,雖然令人印象深刻,但在某些情況下可能無法完全匹配人類創作的組成的細微差異。使用者應準備對輸出進行微調和調整,以更好地滿足他們的特定需求。

為了充分利用 ACE-Step v1.5,使用者應熟悉其各種功能和設置。該模型提供多種語言的廣泛文檔,包括 Gradio Web UI、Studio UI、VST3 插件、Python API、REST API 和 CLI 的指南。這些資源提供了詳細的說明,從基本的音樂生成到高級自訂和訓練,如何有效地使用該模型。透過探索這些工具,使用者可以釋放 ACE-Step v1.5 的全部潛力,創作出符合他們創意願景的音樂。

總之,ACE-Step v1.5 代表了開源音樂生成領域的重大進步,為創作者提供了一個強大且多功能的工具。其速度、品質和自訂選項的結合,使其成為任何希望提升音樂製作能力的人的寶貴資產。儘管存在一些硬體和品質方面的考慮,但對於大多數使用者來說,使用 ACE-Step v1.5 的好處遠遠超過了權衡。透過利用其先進的功能和廣泛的文檔,創作者可以產生高品質的音樂,反映他們獨特的風格和願景。