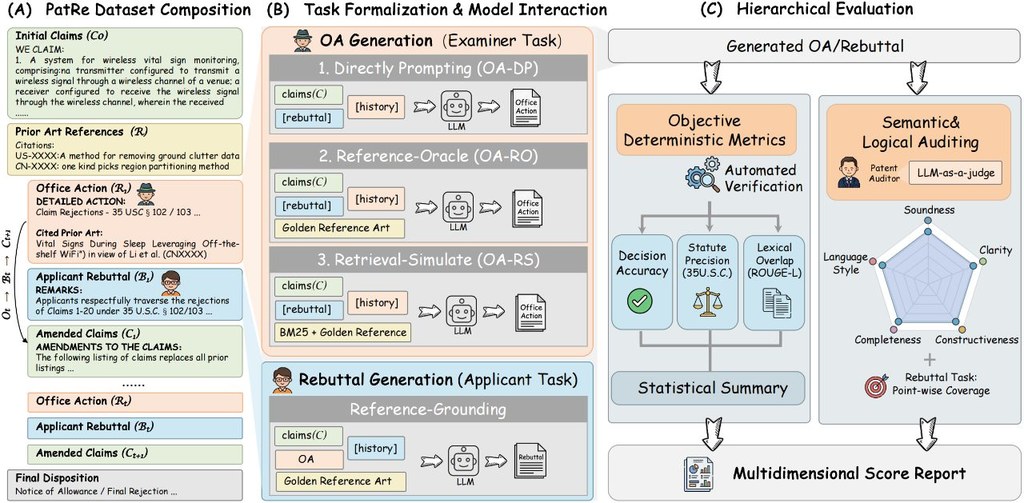

PatRe 是一個聚焦專利審查流程的評測專案,核心在於把任務從單次分類或抽取,推進到更貼近實務的「審查意見生成」與「申請人答辯生成」。以目前公開資訊來看,這個儲存庫主要提供的是評估與生成流程,而不只是靜態資料展示。

實際使用上,使用者需要先準備測試集路徑與參考資料池,之後可選擇只生成結果、只做評估,或限制樣本數進行小規模測試。它也支援既有結果資料夾的評分,對研究者反覆比較不同模型或提示策略會更方便。

這個專案較有意思的地方,在於它把專利審查視為多階段、互動式的文字推理工作,而不是單純預測標籤。README 也提到資料對齊流程會結合 BM25 從 reference pool 擷取相關內容,讓評測不只看模型寫得像不像,還更接近依據檢索材料進行論述的情境。

重點摘要如下:

– 任務設計完整:涵蓋 Office Action 與 rebuttal,不只單向生成。

– 評測流程彈性:可分開執行生成與評估,也能限制樣本或輪次。

– 資料格式務實:支援格式化 JSON 陣列,並保留舊版 JSONL 載入能力。

– 檢索導向:透過 reference pool 與 BM25 對齊,模擬實際審查參照依據。

若你是做法律科技、專利 NLP,或想評估大型語言模型在高約束推理場景的表現,PatRe 很值得關注。特別適合拿來比較模型在審查方與申請方兩種角色中的落差;不過目前公開說明也顯示,資料集與完整展示仍在逐步釋出,實際覆蓋範圍建議以官方後續更新為準。

Source: https://github.com/AIforIP/PatRe