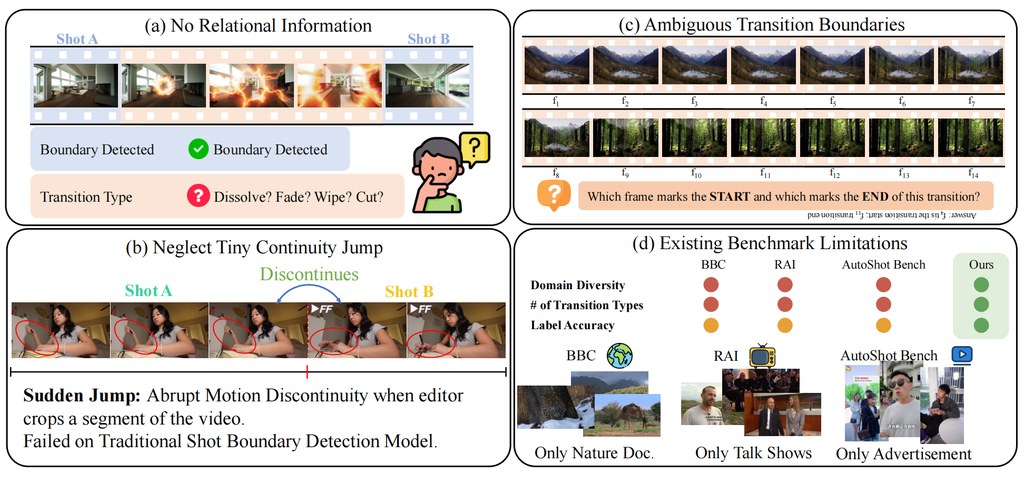

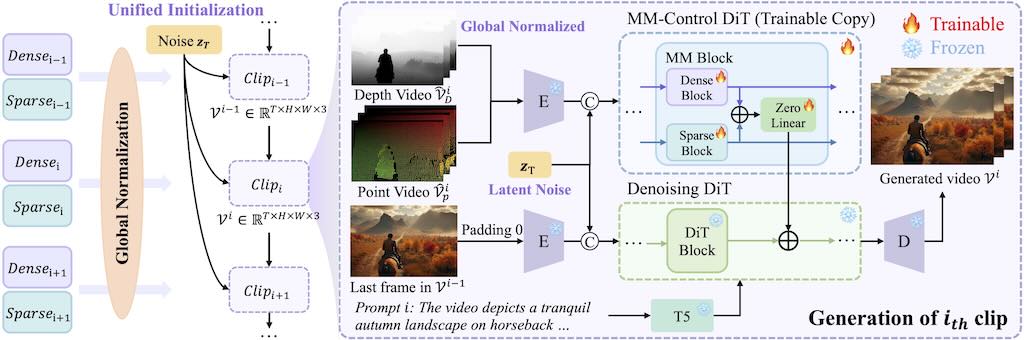

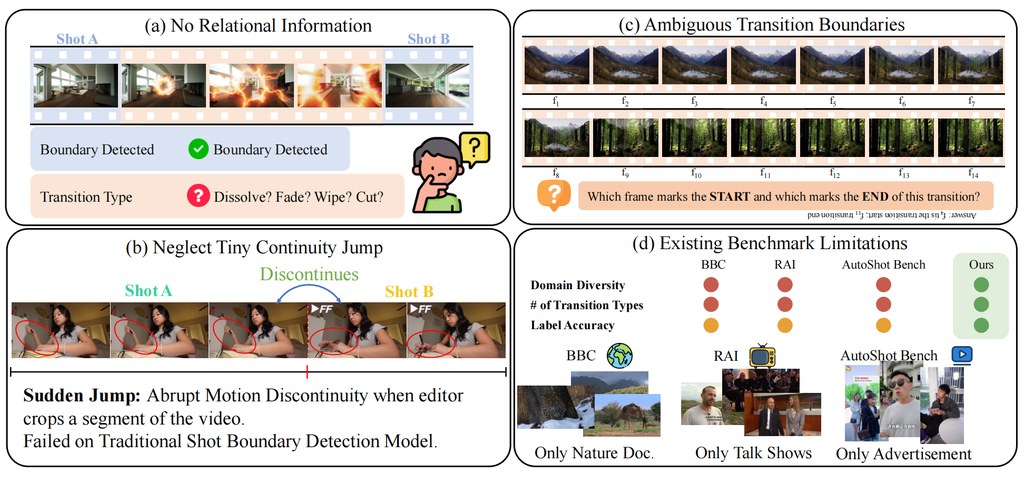

OmniShotCut 作為一種先進的解決方案,在各種類型的影片中都能出色地偵測鏡頭邊界,從動畫到體育轉播皆適用。該工具採用基於鏡頭查詢的影片轉換器,與傳統方法相比,提供了更高的靈敏度和資訊豐富性。處理多樣化影片來源的影片編輯師、內容創作者和研究人員應該考慮使用 OmniShotCut,因為它能夠準確識別突兀的跳接和微妙的轉場如溶解和漸變。對於初次使用該工具的人,首先理解鏡頭查詢機制的核心概念可以提供堅實的基礎。這種方法使模型能夠有效地分析和分類影片中的不同類型的鏡頭變化,特別適合需要對影片編輯過程進行精確控制的專業人士。

實際上,OmniShotCut 通過其複雜的轉換器架構處理影片幀來運作。模型學習根據視覺線索和時間關係區分不同的鏡頭類型。用戶可以從這項技術中獲益良多,特別是在處理需要細緻編輯的大批量影片內容時。自動偵測這些邊界可以節省大量的時間和精力,讓編輯師能夠專注於創意方面而非手動分割。此外,本地 Gradio 介面的加入簡化了實驗和與現有工作流程的整合,即使對那些程式設計經驗有限的人也同樣易於使用。

OmniShotCut 的主要受益者是媒體製作專業人士、研究影片內容的學術研究人員以及從事影片分析應用的開發人員。這些群體可以利用該工具的能力來提升他們項目的品質和效率。然而,需要注意潛在的權衡。雖然 OmniShotCut 在準確性和多功能性方面表現優異,但用戶必須確保擁有足夠的計算資源以高效運行模型。此外,底層轉換器架構的複雜性可能對不熟悉深度學習概念的用戶構成挑戰。因此,基本的機器學習原則理解將會很有幫助。

為了最大化 OmniShotCut 的效益,用戶應從探索提供的 Gradio 示範開始。這種親手實踐的體驗可以提供對模型性能的洞察,並有助於理解其輸出。觀察的重點包括模型如何處理不同類型的影片以及其鏡頭變化偵測的準確性。透過實驗各種輸入影片,用戶可以對將 OmniShotCut 應用於特定需求充滿信心。此外,在推理過程中考慮 clean_shot 模式可以簡化結果,提供僅聚焦於有效鏡頭而無轉場或突兀跳接的乾淨輸出。

OmniShotCut 代表了鏡頭邊界偵測技術的重大進步。其堅固的設計和多功能應用使其成為任何處理影片內容的人的無價資產。儘管在計算需求和技術知識方面存在某些考量,但使用 OmniShotCut 的好處遠遠超過這些小障礙。隨著影片分析領域的不斷髮展,像 OmniShotCut 這樣的工具無疑將在塑造未來創新中發揮關鍵作用。

Source: https://github.com/UVA-Computer-Vision-Lab/OmniShotCut