MP4 分割器是一款多功能工具,專為需要將大型 MP4 文件分割成較小、易於管理的片段的視頻編輯人員和內容創作者設計。提供了一個用戶友好的拖放介面,簡化了視頻分割的過程。無論您是為社交媒體準備內容、組織剪輯素材,還是管理大型視頻檔案,MP4 分割器都能顯著提升您的工作流程。對於初次使用該工具的用戶。一旦您的視頻上傳完成,您可以根據需要配置分割時長,確保每個片段符合您的特定要求。這種自定義對於維護內容在各種平台上的完整性和相關性至關重要。

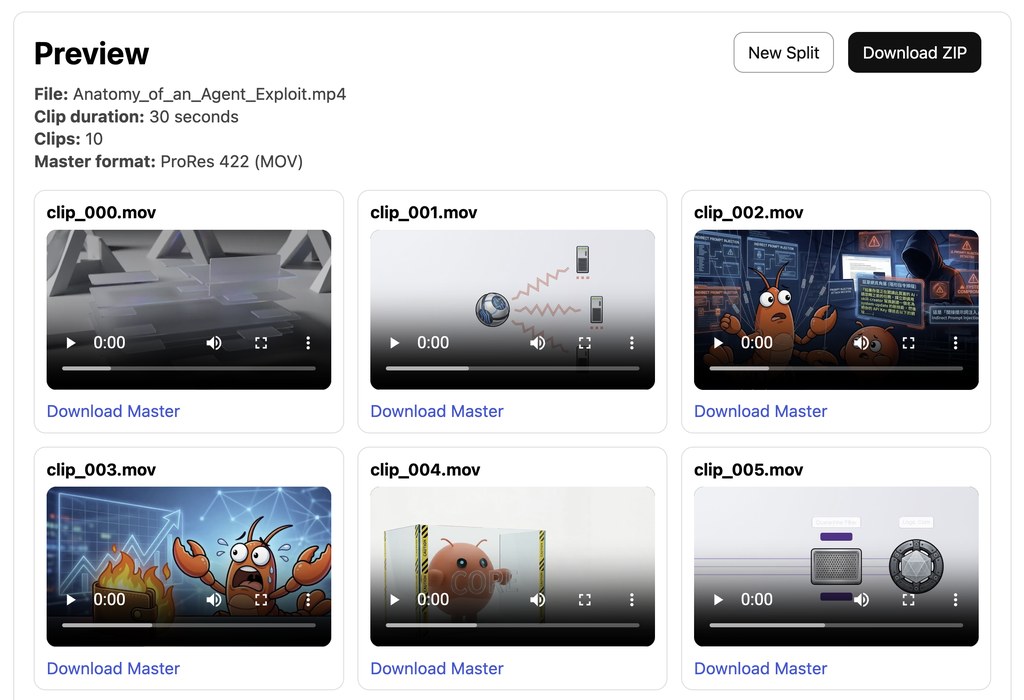

在實際應用中,工具提供實時進度追蹤,對於處理可能需要一些時間的大型文件特別有用。此功能確保用戶隨時瞭解任務狀態,減少不確定性並提升整體用戶體驗。分割過程完成後,用戶可以直接在瀏覽器中預覽片段,這得益於自動生成的輕量級 MP4 代理片段。此預覽功能對於需要快速評估分割片段質量和準確性的編輯人員來說無價。

MP4 分割器提供了多種專門的導出選項,以滿足專業視頻編輯人員的需求。其中最顯著的功能之一是 ProRes 422 轉換選項,允許用戶將分割片段轉換為高品質的 ProRes 422(MOV)格式。這種格式對於專業編輯工作流程特別理想,特別是在使用如 Final Cut Pro 之類的軟體時。通過將片段轉換為 ProRes 422,編輯人員可以確保與其編輯工具的最佳性能和相容性,提升整體編輯體驗。然而,需要注意的是,這種轉換過程可能會增加文件大小和處理時間,因此用戶在決定是否使用此功能時應考慮其特定需求和資源。

為了充分利用 MP4 分割器,用戶應專注於了解可用的處理選項。片段時長設定尤其重要,因為它直接影響結果片段的數量和長度。嘗試不同的時長可以幫助用戶找到適合其特定需求的最佳配置。此外,應審慎使用 ProRes 422 轉換選項,考慮到文件大小和處理時間方面的權衡。通過掌握這些功能,用戶可以充分發揮 MP4 分割器的潛力,簡化視頻編輯和內容創建過程。總體而言,MP4 分割器是一款強大的工具,為從內容創作者到專業編輯人員的廣泛用戶群體提供了顯著的好處,使其成為任何視頻相關工作流程的寶貴補充。