目前最詳細的AI影視劇創作專業流程講解,運用傳統影視工業流程思維幫助你製作出更好的AI影視作品

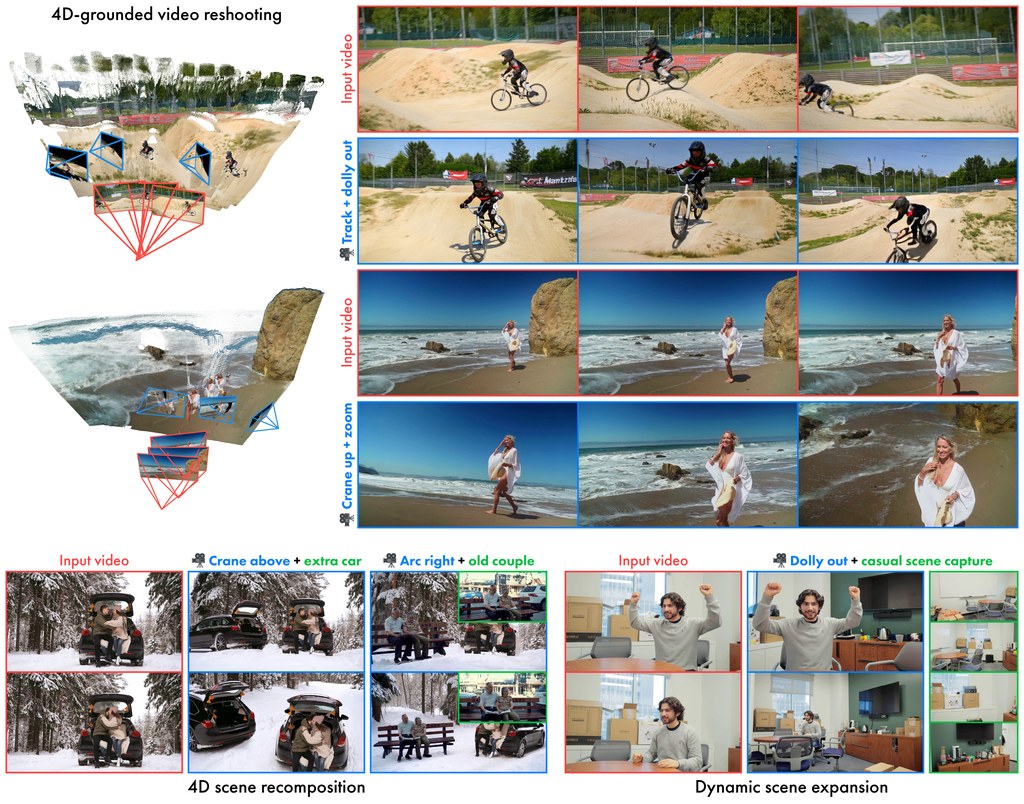

Vista4D 使用 4D 點雲進行視頻重拍

Vista4D 提供了一種獨特的視頻重拍方法,通過從新的角度合成場景。它利用 4D 點雲有效地處理現實世界中的視頻缺陷。這使得它特別適合希望擴展其視覺敘事能力的創作者。

在開始使用 Vista4D 時,重點是理解其核心功能——從新穎的角度重拍視頻。該框架對點雲工件的強健性確保了即使在不完美的重建下也能可靠運行。此特性對於維護場景完整性至關重要。

在實際應用中,Vista4D 受益於動態場景擴展和 4D 場景重組的專業人士。它在保留場景內容的同時允許精確的相機控制,為創意編輯打開了大門。用戶可以預期在視頻製作流程中獲得增強的靈活性。

該框架需要一個強大的大型語言模型(LLM)以獲得最佳結果。創作者和編輯人員將發現 Vista4D 因其創新性的視頻操作方法而極具價值。

• 使用新穎視角增強視頻重拍

• 對點雲工件具有強健性

• 適合動態場景擴展和重組

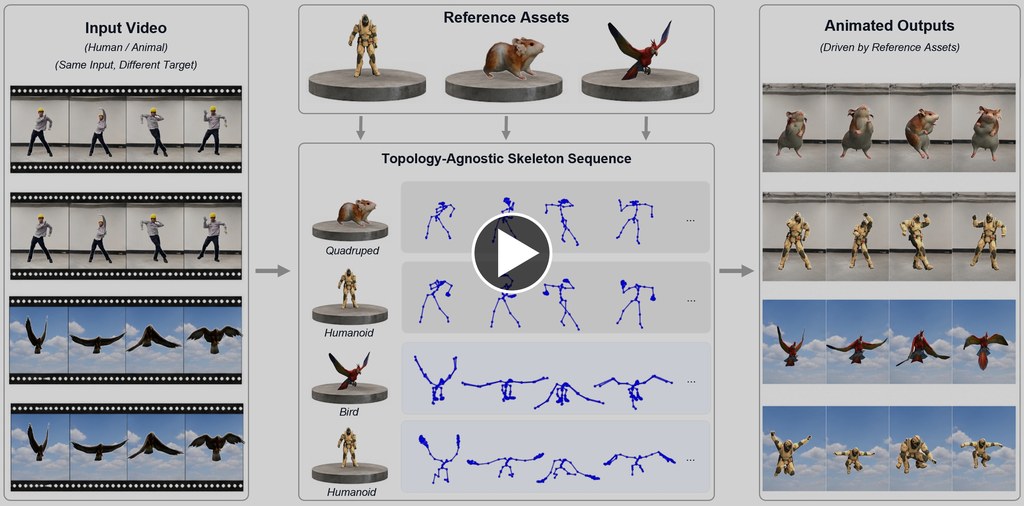

MocapAnything 創新的動作捕捉方法

MoCapAnything V2 為那些從事動畫、遊戲開發和需要動作捕捉能力的研究人員提供了一個令人信服的解決方案。該工具通過將單目視頻轉換為詳細的骨骼動畫而脫穎而出,而不依賴於中間網格模型。對於希望在保持高精度的同時簡化工作流程的專業人士來說,MoCapAnything V2 值得探索。最初,用戶應專注於理解參考錨定旋轉的核心概念,這簡化了使用單一參考姿勢-旋轉對將姿勢轉換為旋轉的過程。這種方法確保生成的動畫既精確又在不同資產之間保持一致。

在實踐中,MoCapAnything V2 通過其主要模型 video2pose2rot 運行,該模型整合了兩個子任務:從視頻幀預測關節位置(video2pose)和將這些位置轉換為關節旋轉(pose2rot)。這些任務共同優化,消除了對分析逆運動學的需求。結果是一個無縫的管道,可以直接從輸入視頻提供 BVH 準備好的關節旋轉。這種方法不僅提高了效率,還為速度至關重要的實時應用打開了可能性。處理多樣角色模型的動畫師和開發人員將發現這特別有益,因為該系統可以使用匹配物種的參考框架來適應各種骨骼結構。

在其項目中處理複雜、任意骨骼的人。無論是動畫人類角色還是奇特生物,該工具的靈活性都允許在沒有傳統方法約束的情況下進行準確的動作捕捉。計算機視覺和機器學習領域的研究人員也會欣賞這一端到端優化的創新,為動作捕捉技術的進一步發展提供了堅固的框架。

然而,也有一些權衡需要考慮。雖然無網格的方法顯著提升了處理速度,但它可能無法捕捉到基於網格系統所能處理的細節。用戶應評估 MoCapAnything V2 提供的細節水平是否符合他們項目的要求。此外,對參考姿勢的依賴意味著為了獲得最佳結果,需要仔細選擇和校準。儘管有這些考慮,MoCapAnything V2 所提供的優勢使其成為任何從事動作捕捉的人的工具箱中有價值的添加。

MoCapAnything V2 在動作捕捉技術方面代表了一個重要的進步。其端到端設計,加上參考錨定旋轉和無網格處理,使其成為動畫師、遊戲開發者和研究人員的強大工具。通過專注於關鍵特徵並理解實際影響,用戶可以有效地利用此工具。雖然有一些限制需要注意,但對於許多應用而言,提高效率和靈活性的好處遠遠超過缺點。

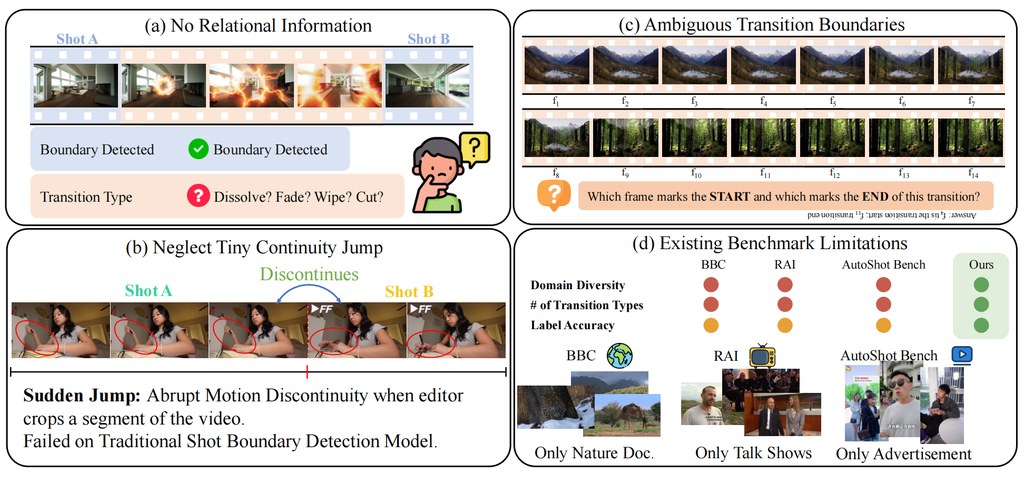

OmniShotCut 在鏡頭邊界偵測任務的最新技術

OmniShotCut 作為一種先進的解決方案,在各種類型的影片中都能出色地偵測鏡頭邊界,從動畫到體育轉播皆適用。該工具採用基於鏡頭查詢的影片轉換器,與傳統方法相比,提供了更高的靈敏度和資訊豐富性。處理多樣化影片來源的影片編輯師、內容創作者和研究人員應該考慮使用 OmniShotCut,因為它能夠準確識別突兀的跳接和微妙的轉場如溶解和漸變。對於初次使用該工具的人,首先理解鏡頭查詢機制的核心概念可以提供堅實的基礎。這種方法使模型能夠有效地分析和分類影片中的不同類型的鏡頭變化,特別適合需要對影片編輯過程進行精確控制的專業人士。

實際上,OmniShotCut 通過其複雜的轉換器架構處理影片幀來運作。模型學習根據視覺線索和時間關係區分不同的鏡頭類型。用戶可以從這項技術中獲益良多,特別是在處理需要細緻編輯的大批量影片內容時。自動偵測這些邊界可以節省大量的時間和精力,讓編輯師能夠專注於創意方面而非手動分割。此外,本地 Gradio 介面的加入簡化了實驗和與現有工作流程的整合,即使對那些程式設計經驗有限的人也同樣易於使用。

OmniShotCut 的主要受益者是媒體製作專業人士、研究影片內容的學術研究人員以及從事影片分析應用的開發人員。這些群體可以利用該工具的能力來提升他們項目的品質和效率。然而,需要注意潛在的權衡。雖然 OmniShotCut 在準確性和多功能性方面表現優異,但用戶必須確保擁有足夠的計算資源以高效運行模型。此外,底層轉換器架構的複雜性可能對不熟悉深度學習概念的用戶構成挑戰。因此,基本的機器學習原則理解將會很有幫助。

為了最大化 OmniShotCut 的效益,用戶應從探索提供的 Gradio 示範開始。這種親手實踐的體驗可以提供對模型性能的洞察,並有助於理解其輸出。觀察的重點包括模型如何處理不同類型的影片以及其鏡頭變化偵測的準確性。透過實驗各種輸入影片,用戶可以對將 OmniShotCut 應用於特定需求充滿信心。此外,在推理過程中考慮 clean_shot 模式可以簡化結果,提供僅聚焦於有效鏡頭而無轉場或突兀跳接的乾淨輸出。

OmniShotCut 代表了鏡頭邊界偵測技術的重大進步。其堅固的設計和多功能應用使其成為任何處理影片內容的人的無價資產。儘管在計算需求和技術知識方面存在某些考量,但使用 OmniShotCut 的好處遠遠超過這些小障礙。隨著影片分析領域的不斷髮展,像 OmniShotCut 這樣的工具無疑將在塑造未來創新中發揮關鍵作用。

Source: https://github.com/UVA-Computer-Vision-Lab/OmniShotCut

Prompt-Relay:一種推論階段、即插即用的多事件生成時間控制方法

Prompt Relay 是一種令人信服的解決方案,適用於那些應對視頻生成中時間控制複雜性的挑戰。這種由 Gordon Chen、Ziqi Huang 和 Ziwei Liu 開發的推論階段方法,解決了當前視頻擴散模型中的一個重要缺口:管理視頻中多個事件的精確時間、持續時間和順序的能力。通過在交叉注意力機制中引入時間路徑先驗,Prompt Relay 確保每個提示被定位到其預定的片段,從而改善時間對齊、轉場自然性和視覺質量。這對於需要連貫敘事的應用特別有價值,例如電影級合成或詳細動畫。

對於希望增強視頻生成能力的創作者和開發者,Prompt Relay 提供了一個簡單的起點。該方法專注於通過距離基於的懲罰修改交叉注意力機制,抑制潛在查詢和提示令牌在其指定區間之外的注意力。這種方法允許用戶在不需重新訓練基礎模型的情況下,微調視頻生成的時間方面。這種即插即用解決方案的簡單性意味著用戶可以快速將其整合到現有流程中,使其適用於廣泛的應用。

在實踐中,Prompt Relay 通過採用一個全局提示來條件整個視頻和一系列本地提示,每個本地提示對應一個特定的時間段。全局提示有助於在整個視頻中維持一致的角色、物件和場景上下文,而本地提示則為個別片段提供詳細指令。這種雙提示系統確保視頻的每個部分都由適當的指令引導,減少語義滲漏並改善整體一致性。用戶應專注於編寫清晰和具體的提示,以最大化這種方法的好處。

Prompt Relay 的創作者通過各種定性結果展示了其有效性。該方法顯著改善了時間對齊,確保每個事件在其預定的時間框架內發生。它還增強了轉場自然性,使不同事件之間的交接更為順暢和無縫。此外,Prompt Relay 通過最小化交叉注意力中的不必要的競爭,提升了視覺質量,從而實現更清晰和更穩定的多事件生成。這些改進在與基線提示策略和一些最近的強大模型如 Kling 3.0 相比時尤為顯著。

提示中繼功能改進:

- 時間對齊,即將每條指令限制在其分配的段落內。

- 透過確保事件在不同時間點之間的平穩交接,實現過渡的自然性。

- 透過減少不必要的注意力交叉競爭來提高視覺品質。

Prompt Relay 的性能始終優於基準提示策略,與Kling 3.0等近期推出的優秀模型相比也保持競爭力。尤其值得一提的是,Wan 2.2 + Prompt Relay通常比基礎 Wan 2.2 模型能夠產生更強大的視覺結構和更穩定的多事件。

| 指標(↓) | 索拉(故事板) | Kling 2.6 | Veo 3.1 | Wan 2.2 | Wan 2.2 + 即時中繼(我們的) |

|---|---|---|---|---|---|

| 時間對齊 | 4.67 | 1.30 | 3.93 | 4.00 | 1.10 |

| 過渡自然性 | 4.60 | 4.43 | 1.30 | 3.50 | 1.17 |

| 視覺品質 | 3.67 | 2.50 | 2.0 | 4.00 | 2.83 |

對視頻生成的時間方面進行精確控制的內容創作者、動畫師和開發者。例如,電影製作者可以使用這種方法創建更連貫和引人入勝的敘事線,而動畫師可以產生更順暢和詳細的動畫。需要注意的權衡包括編寫詳細提示的潛在複雜性和為實現最佳結果而需仔細校準距離基於的懲罰。用戶應嘗試不同的設置和提示結構,以找到適合其特定需求的最佳配置。

雖然 Prompt Relay 中使用的具體模型沒有明確提及,但似乎與各種視頻擴散模型兼容,包括 Wan 2.2。這種兼容性允許用戶利用不同模型的優勢,同時受益於 Prompt Relay 提供的時間控制。該方法的靈活性和易於整合性使其成為任何希望增強視頻生成能力的人的寶貴工具。通過應對時間控制的挑戰,Prompt Relay 為視頻合成領域的創意和技術應用打開了新的可能性。

總之,Prompt Relay 提供了一種實用且有效的解決方案,用於改善視頻生成中的時間控制。其簡單的實現和顯著的好處使其成為內容創作者和開發者的有吸引力的選擇。通過專注於編寫詳細的提示和仔細校準該方法的參數,用戶可以實現更連貫、自然和視覺上更具吸引力的視頻。儘管可能需要考慮一些權衡,但 Prompt Relay 的整體優勢使其成為任何視頻生成工具包的值得添加的內容。

SpatialEdit:精細圖像空間編輯的基準測試

SpatialEdit 是一款開創性的工具,適用於對圖像進行精細空間編輯感興趣的人士。它特別適用於需要對物件運動、旋轉、3D視角、構圖和相機移動進行精確控制的開發人員、研究人員和愛好者。該工具不僅僅改變圖像的外觀,還能實現詳細的空間操作。對於任何想深入這一領域的人,首先應該關注 SpatialEdit 的核心功能,例如它處理3D點控制、基於條件幀的視頻生成、相機軌跡轉換、物件移動和物件旋轉的能力。這些功能通過倉庫中的各種應用示範,提供了該工具在實踐中可以實現的清晰視圖。

在實踐中,SpatialEdit 通過結合先進的模型和合成數據集來工作。例如,SpatialEdit-500K 數據集是一個使用可控制的Blender管道生成的合成訓練集。該數據集為物件中心和相機中心操作提供了精確的真實轉換,使其對於可擴展的訓練無價之寶。建立在這些數據上的 SpatialEdit-16B 模型,作為精細空間編輯的基線,不僅在一般編輯任務上達到競爭性表現,而且在空間操作上表現出色。用戶應注意運行代碼所需的先決條件和外部檢查點,例如用於相機級基準評估的VGGT和用於構圖評估的YOLO26x。

從中受益最大的人是那些從事計算機視覺、圖像處理和機器學習研究的人。研究人員可以使用基準測試套件 SpatialEdit-Bench 來評估他們的空間編輯模型的有效性。該基準聯合測量感知逼真度和幾何保真度,確保編輯的圖像不僅在視覺上可信,而且在幾何上準確。對於開發人員,SpatialEdit 提供了一個堅固的框架,用於創建需要對圖像進行精確空間控制的應用,例如在虛擬現實、增強現實和數字內容創作中。

然而,需要考慮一些權衡。設置過程可能很複雜,需要兼容的CUDA和PyTorch環境來運行閃電注意力機制。此外,一些配置文件包含需要在運行推理之前更新的佔位符或內部路徑。用戶還應注意,基準腳本假設可以訪問外部基準元數據、源圖像和模型檢查點。這些要求對於新入行的人可能構成挑戰,但倉庫中提供的詳細文檔和示例評估工具可以幫助減輕這些問題。

總之,SpatialEdit 是一個強大的空間基礎圖像編輯工具,提供對各種空間轉換的精確控制。它最適合需要進行精細空間操作的研究人員和開發人員。用戶應專注於了解該工具的核心功能和先決條件,同時注意其中的權衡。通過利用 SpatialEdit-500K 數據集和 SpatialEdit-16B 模型,可以在空間編輯任務中達到競爭性表現。對於計算機視覺和圖像處理領域的人來說,其好處是顯著的,但要充分利用該工具的潛力,需要仔細設置和配置。

- 主要功能:3D點控制、基於條件幀的視頻生成、相機軌跡轉換、物件移動和物件旋轉。

- 目標受眾:計算機視覺、圖像處理和機器學習領域的研究人員、開發人員和愛好者。

- 權衡:複雜的設置過程、需要兼容的硬體和軟體環境,以及更新配置文件中的內部路徑。

掌控生成方向!LTX-2.3 IC-LORA 多重控制

Pulse of Motion 讓影片更自然

Pulse of Motion 讓你在觀看影片時「感覺更舒服」,但看不到技術本身。目前很多生成影片(如 SVD、Pika 等)的動作時間常常跑偏,作者稱這種現象為 chronometric hallucination,也就是「看起來平滑但實際上時間尺度錯亂」。

現在很多生成模型會「時間錯亂」角色走路太快/太慢;手勢、動作和音效不搭;看起來動作很順,但「感覺怪怪的」。這套技術可以用來:調整生成模型的輸出(例如:自動快慢放或重採樣),讓影片「更像真實拍攝」,看起來更舒服。自動檢測影片的 真實時間尺度;

RealRestorer – 通用真實世界影像復原

RealRestorer 是一個開源、通用型實拍圖像修復模型,目標是統一處理多種真實世界降級(blur、rain、low‑light、noise、haze 等),同時盡量保留原始場景結構與細節。

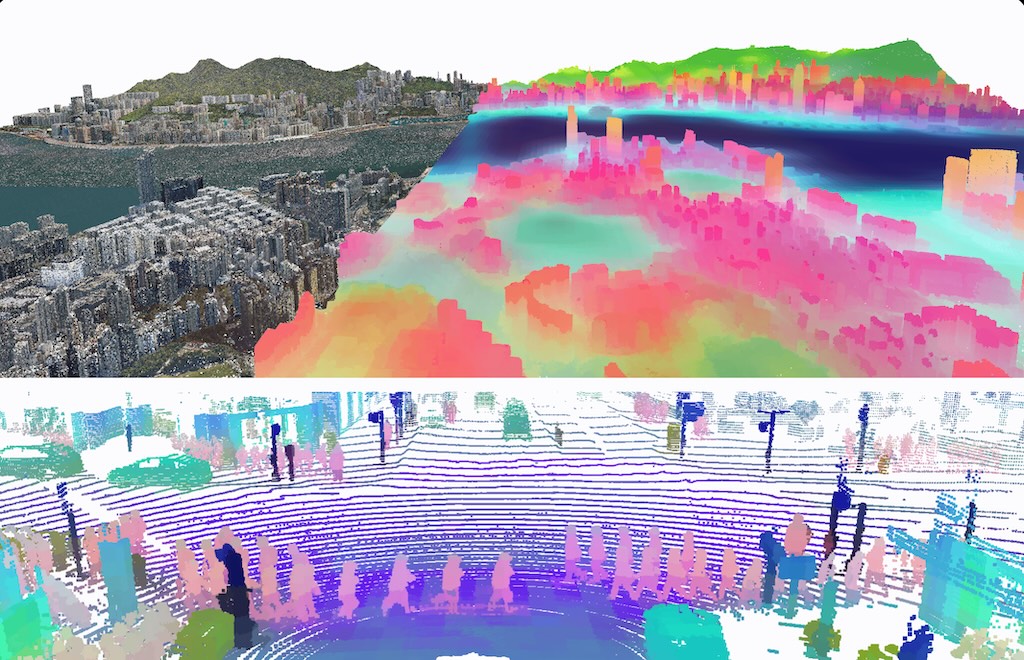

Utonia – Point Cloud 的單一編碼器

Utonia 是一個統一的自監督點雲 Transformer 編碼器,目標是「一個編碼器適用於所有點雲域」,也就是在不同感測器與場景(遙感、戶外 LiDAR、室內 RGB‑D、物件級 CAD 模型、單目視頻轉 3D 點雲等)上共享同一個 backbone,讓預訓練特徵能跨域遷移。

Utonia 在大量異構點雲資料上 jointly 預訓練一個單一的 Point Transformer V3 編碼器,不依賴 domain‑specific 的頭或模組,只用一個 shared representation space。

跨域資料混合:

研究中混合了遙感(衛星/航拍)、自駕車用 LiDAR、室內 RGB‑D 掃描、CAD 物件模型、以及從 RGB 影片 lift 上來的點雲,一起放入 masked autoencoding 式的自監督訓練流程。