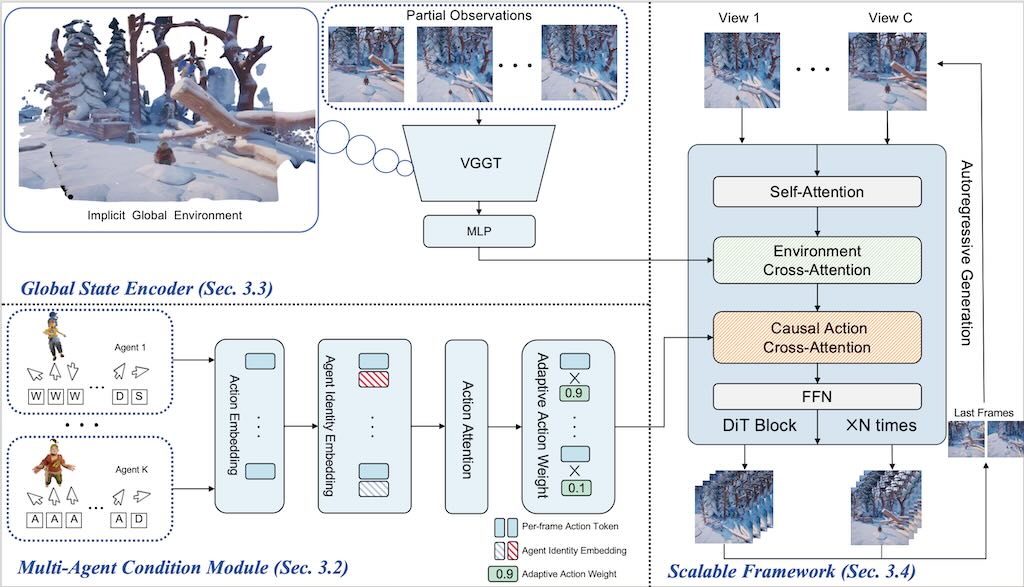

MultiWorld 在可擴充的多代理、多視角視頻世界模型的開發上代表了一個重要的進步。這個專案對於那些希望在複雜環境中模擬多個代理和視角的人工智慧和機器人領域的研究人員和開發人員特別有價值。在深入研究 MultiWorld 時,首先需要理解其基礎概念:建立一個虛擬世界,讓多個代理能夠同時從各種角度進行互動和學習。這種設定不僅增強了模擬的真實感,還提供了一個堅實的平台,用於在動態和不可預測的情境中測試和優化 AI 算法。

在實際應用中,MultiWorld 通過將先進的機器學習技術與複雜的模擬環境相結合來運作。該系統允許創建詳細的虛擬世界,每個代理可以從其獨特的視角感知環境,與其他代理互動,並從這些互動的結果中學習。這種方法對於需要高度情境意識和適應性決策的應用特別有益,例如自動駕駛汽車導航或複雜的機器人任務。然而,需要注意的是,這種系統的複雜性也帶來了某些權衡。例如,運行多個代理和視角的計算需求可能相當大,需要強大的硬體和高效的資源管理。

從 MultiWorld 中受益最大的研究人員和開發人員是那些從事需要深入了解多代理互動和多視角感知的專案的人。這包括人工智慧研究、機器人技術,甚至遊戲開發領域的專業人士,這些領域中真實和動態的環境是必不可少的。通過利用 MultiWorld,這些專業人士可以創建更準確的模擬,從而做出更明智的決策和創新。然而,實施時必須清楚了解專案的目標和模擬環境的具體需求。

在考慮將 MultiWorld 用於專案時,有幾個因素需要注意。首先,系統的複雜性意味著需要對底層的機器學習演算法和模擬環境有深入的了解。這可能需要額外的培訓或與這些領域的專家合作。其次,運行模擬所需的計算資源可能是相當大的,因此仔細規劃和優化是必不可少的。最後,雖然 MultiWorld 為模擬多代理、多視角場景提供了一個強大的工具,但重要的是要認識到其侷限性,並考慮這些侷限性可能如何影響專案的結果。通過仔細權衡這些考慮因素,開發人員和研究人員可以最大化 MultiWorld 的好處,同時最小化潛在的缺點。

對於那些希望在多代理系統和多視角模擬領域取得進展的人來說,MultiWorld 提供了一個令人信服的機會。儘管在理解和資源方面需要大量的投資,但在增強模擬能力和改進 AI 算法方面的潛在回報是巨大的。對於那些準備應對挑戰的人,MultiWorld 為人工智慧和機器人領域的創新和發現提供了一個強大的平台。