Flow-OPD 是一個針對 Flow Matching 文生圖模型的後訓練框架,核心目標不是單純追高某一項分數,而是把 OCR、組合理解、問答與人類偏好等不同能力整合進同一個學生模型。從公開資訊來看,它建立在 SD-3.5-Medium 上,並以兩階段流程處理「先培養專長、再統一能力」這個多任務對齊難題。

實際使用上,這個專案目前較適合研究者或進階生成模型開發者參考其方法與權重,而不是一般使用者直接拿來當完整訓練工具鏈。README 顯示模型權重已釋出,但完整訓練程式仍在進行中,因此比較合理的使用方式,是先檢視論文與模型成果,再評估是否將其蒸餾思路移植到自己的 Flow Matching 訓練流程。

它最值得注意的創新,在於把原本稀疏的標量獎勵,改成由多個教師模型提供的軌跡級稠密向量場監督。配合 on-policy 的 SDE 採樣,學生模型能在自身生成軌跡上接受更細緻的指導;再加上 MAR 正則化,則是用來降低純 RL 對齊常見的美感退化問題,這點對文生圖品質維持特別重要。

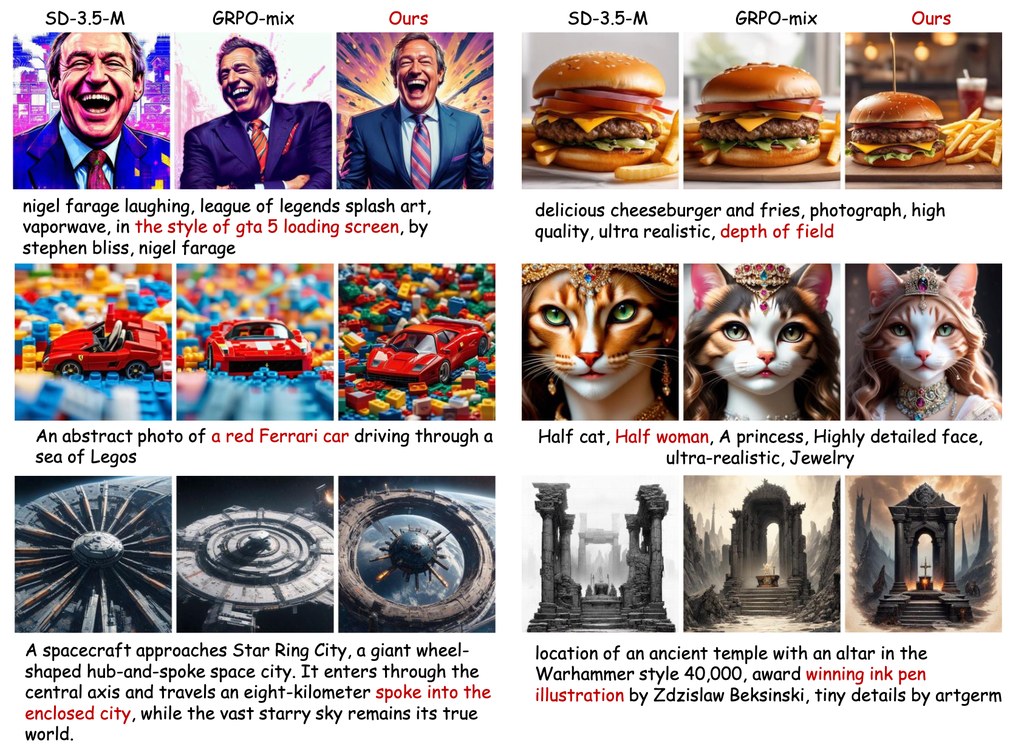

從結果看,Flow-OPD 的價值在於它不只比 vanilla GRPO 更強,還試圖解決多任務訓練常見的「翹翹板效應」。公開數據顯示,該方法在 GenEval、OCR、DeQA 與 PickScore 上都有提升,平均表現優於基線,且在 OCR、DeQA 上甚至出現超越個別教師的現象;不過這些結論仍應以論文設定與基準環境為前提理解。

- 定位明確:專注於 Flow Matching 文生圖模型的多任務後訓練與對齊。

- 方法新意:以多教師稠密監督取代單一標量獎勵,降低任務間梯度干擾。

- 實務亮點:MAR 用來守住美感品質,避免只追指標造成生成退化。

- 適用場景:適合需要同時兼顧文字生成、構圖理解與偏好對齊的通用型文生圖系統。

- 使用前提:目前較偏研究型專案,若要重現訓練流程,可能仍需等待完整訓練程式公開。

Model download: https://huggingface.co/CostaliyA/Flow-OPD