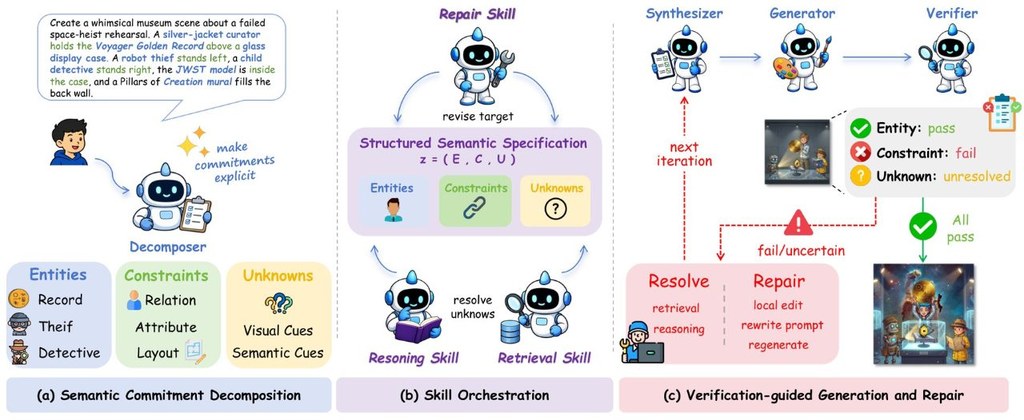

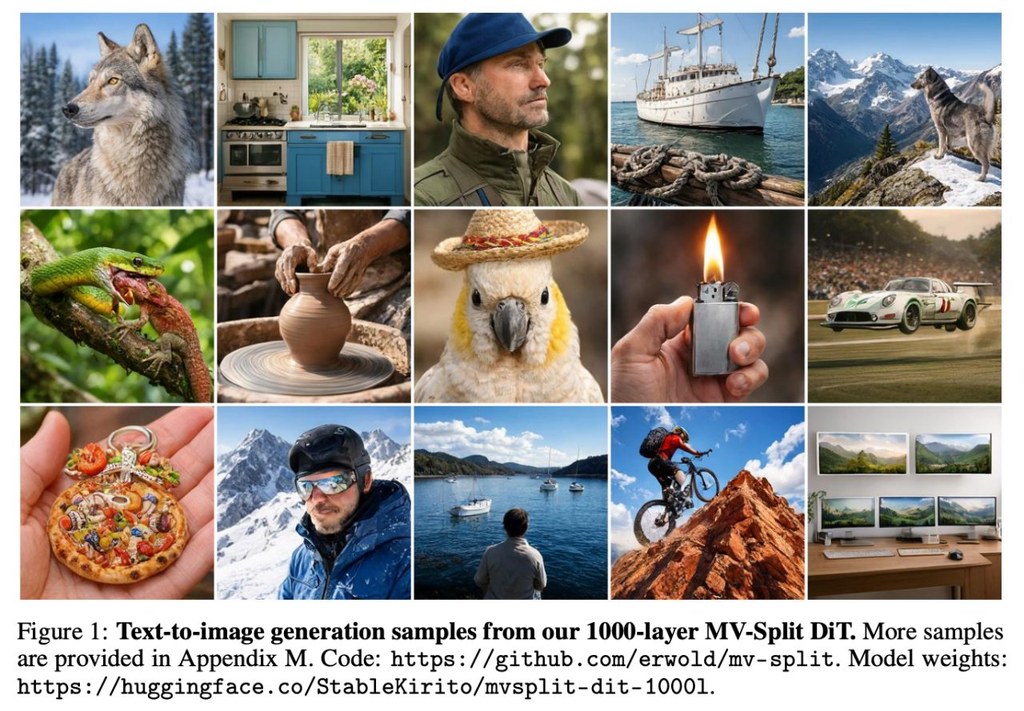

mv-split 是一個用來產生圖片的研究型專案,核心是名為 MVSplit-DiT 的超深層模型,整體深度達 1000 層。它不是一般即裝即用的圖片工具,而是較適合想測試新一代生成架構、比較效能,或者重現論文結果的人使用。

實際使用上,流程算清晰:先準備模型權重、FLUX.2 的自編碼器,以及 Qwen3 文字編碼器,之後透過 sample.py 輸入提示詞、指定輸出資料夾,就可以生成圖片。它亦支援從範例提示詞清單逐行抽樣、隨機抽樣,甚至一次過跑完整批提示,方便做測試和比較。

這個專案最值得留意的地方,是它同時提供 Triton 核心加速與 PyTorch 後備路徑。換句話說,就算機器沒有 Triton,理論上仍可運行;只是對於 1000 層這種深度,README 已明確提醒 CPU 雖可作後備,但實際上並不實用,較合適的環境仍是 PyTorch 2.x 配合 CUDA。

- 採用超深層 DiT 架構,定位偏研究與高階實驗

- 以 Triton 核心加速多個關鍵運算,同時保留 PyTorch 後備

- 可直接用自訂提示詞、提示詞檔案或批次方式生成圖片

- 會輸出 PNG 圖片及 metadata.jsonl,方便記錄實驗結果

從設計來看,它的主要創新不只在「層數夠深」,亦包括把多個底層運算元件拆得相當明確,例如 RoPE、RMSNorm、QK-Norm 和 SwiGLU 都有獨立實作,顯示作者很重視推論路徑的效率與可替換性。這種做法對一般用家未必直接有感,但對開發者或研究者來說,代表更容易針對效能瓶頸做調整。

最適合的應用場景,包括生成模型研究、推論效能測試、比較 Triton 與 PyTorch 後備表現,以及重現論文方法。若你只是想簡單輸入一句文字就穩定出圖,這個專案的門檻會偏高;但若你需要一個結構清楚、可觀察推論細節的實驗平台,它就相當有參考價值。相關模型方面,需配合 FLUX.2 AutoEncoder 與 Qwen/Qwen3-0.6B 文字編碼器。