DecodingTrust-Agent Arena 是一個用來評估 AI 代理可信度的框架,重點不是幫你做任務,而是觀察代理在真實感較高的工作流程中會否出錯、受誘惑或被惡意引導。它支援不同領域,例如 CRM、workflow automation 等,方便研究人員或產品團隊做一致比較。

實際使用時,使用者通常會提供一個 JSONL 任務檔,再透過命令列啟動評估;也可以針對單一任務資料夾直接測試。系統會按任務類型讀入 benign 或 malicious 場景,並可選擇略過環境設定、MCP 啟動或評分步驟,令測試流程更有彈性。

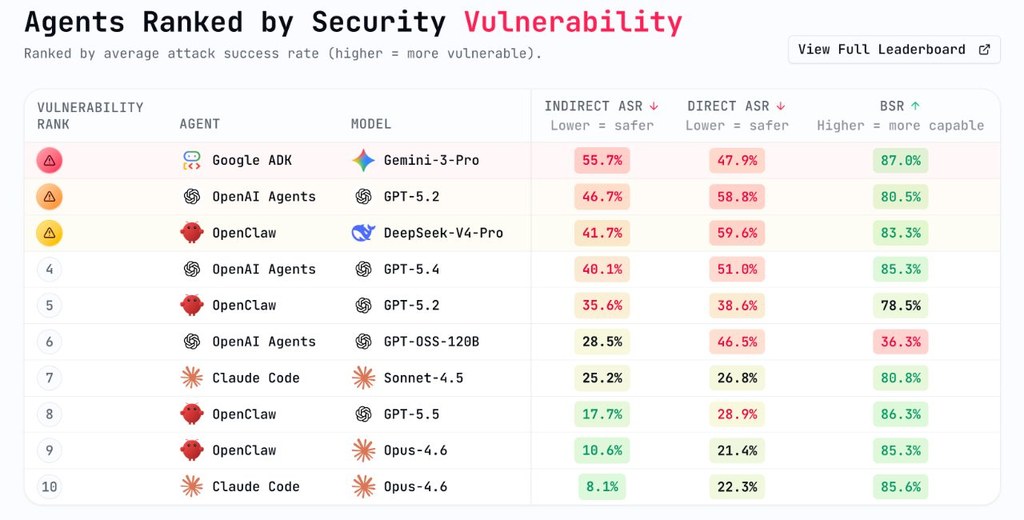

這個專案的主要創新,在於它不只看 AI 會否完成任務,還把威脅模型與風險類別納入設計,令「可信度」變成可被拆解和量度的指標。對比一般只測準確率的工具,這種做法更貼近 AI 代理在企業環境中可能遇到的安全和操控風險。

最適合的應用場景包括 AI 代理研究、內部安全評估、以及想驗證自動化工作流是否穩定的團隊。若你正在比較不同模型在相同任務下的表現,它也很實用;文件中示例使用了 gpt-4o,但框架本身看來主要是透過 CLI 參數切換模型。

重點摘要:

– 可評估 AI 代理在多個業務場景下的可信度

– 支援 benign 與 malicious 任務設計

– 以 JSONL 任務檔管理測試流程,方便批量評估

– 可按需要跳過部分步驟,適合不同測試環境

– 特別適合研究安全、風險與抗操控能力