如果你對機械人或 AI 有興趣,但又唔想一開始就埋頭讀大量論文,Awesome-WAM 其實幾好入手。它本身唔係一個直接拿來部署的機械人程式,而係一個系統化整理庫,集中介紹 World Action Models 這個新方向,並附有每篇論文的重點摘要,方便讀者由概念開始慢慢建立理解。

這個主題想解決的核心問題,其實幾直觀:不少模型能夠由影像或文字直接產生動作,但未必真係「理解」下一步世界會點變。WAM 的做法,是將環境變化預測同動作生成放埋一齊考慮,令機械人唔只係反應快,亦更似先模擬後行動。

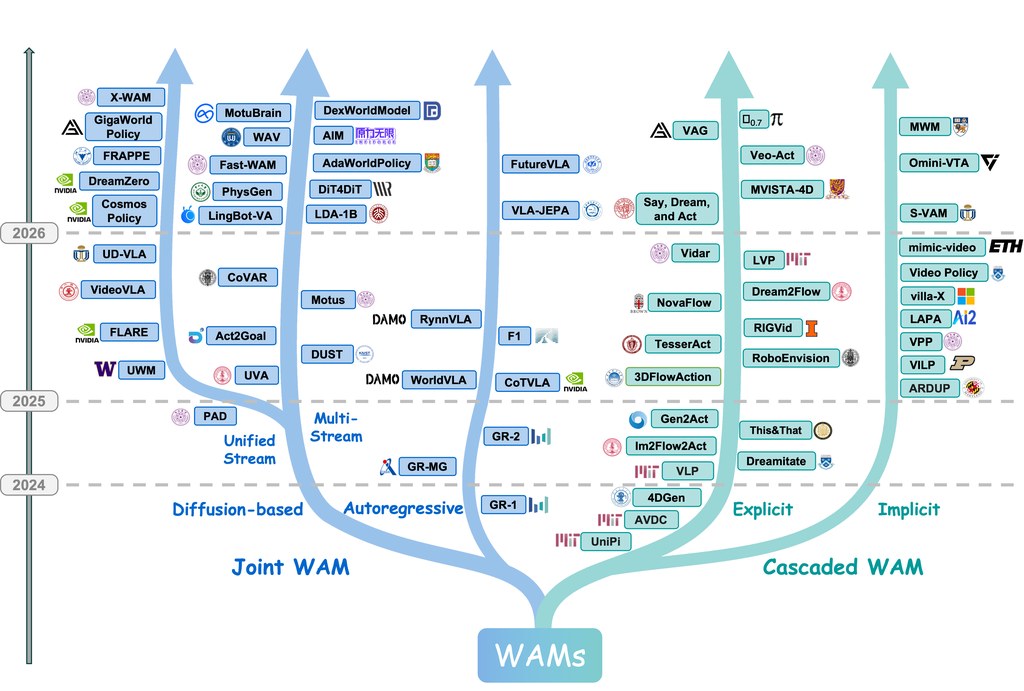

這個儲存庫最有價值的地方,在於它唔單止列論文,而係嘗試用統一框架整理整個領域,例如分開 Cascaded 與 Joint 兩類路線,亦有提到訓練資料來源、評估方式,以及與 Vision-Language-Action 發展之間的關係。對初學者來講,這種分類比單看論文名更易掌握全貌。

- 提供系統化總覽,適合先建立概念再深入讀文獻

- 有每篇文章的簡短導讀,節省篩選時間

- 涵蓋相關模型與方向,如 RT-2、OpenVLA、π0,以及庫內收錄的 DREMA、RoboScape、Ctrl-World

- 重視架構分類、數據來源與評估方法,唔只係單純清單

如果你想上手,最實際做法係先看它對 WAM 的整體定義,再沿分類去揀有興趣的論文摘要閱讀。研究人員、學生、做機械人產品規劃的人都會受用;即使你未必會親自訓練模型,這個整理庫都能幫你較快分清哪些方法偏向預測世界、哪些更強調動作生成控制。

整體來說,Awesome-WAM 比較似一張持續更新的地圖,而唔係單一工具。對想跟進 embodied AI、VLA 與 world model 交叉發展的人,它的價值在於幫你用較低成本看清研究脈絡,同時保留足夠細節,方便之後再深入追文。