AnyFlow 是 NVIDIA Labs 推出的影片擴散框架,重點不是單純把片生出來,而是讓同一個模型可按你手上的運算時間,自由調整推理步數。簡單講,趕時間時可以用較少步數先出結果;有更多資源時,再加步數換取更穩定的細節表現。

實際使用上,它較適合研究員、開發者或內容生成團隊,用來測試文字轉影片、圖片轉影片,以及影片轉影片。README 顯示它已有示範程式和預訓練模型,代表使用者可直接下載模型試效果,而不一定要由零開始訓練。

這個專案較有新意的地方,是把傳統常見「固定步數」的限制放寬,做成 any-step 生成。對非專業人士來說,可理解為同一套引擎在快出片與慢慢精修之間更有彈性,而不是每種速度都要換另一個模型。

- 支援 Text-to-Video、Image-to-Video、Video-to-Video

- 可配合不同推理步數,平衡速度與質素

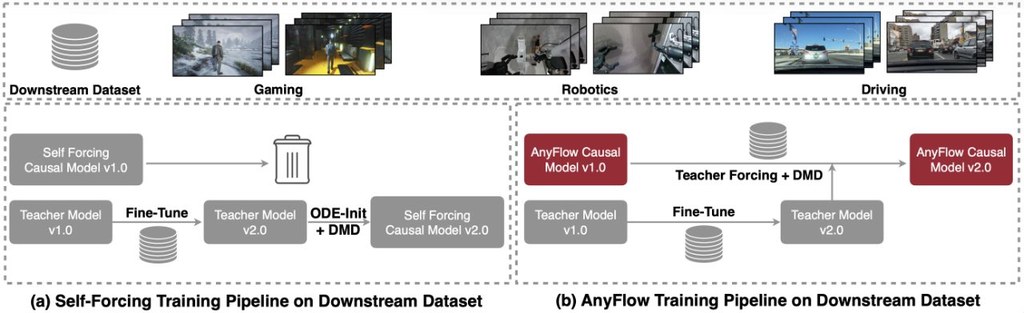

- 涵蓋 causal 與 bidirectional 影片擴散架構

- 已驗證可擴展到 1.3B 至 14B 參數級別

若你要做社交媒體短片原型、廣告分鏡視覺化,或研究影片生成流程,AnyFlow 的定位相當清晰。相關模型方面,README 提到可找到 AnyFlow-FAR-Wan2.1-1.3B-Diffusers、AnyFlow-FAR-Wan2.1-14B-Diffusers、AnyFlow-Wan2.1-T2V-1.3B-Diffusers、AnyFlow-Wan2.1-T2V-14B-Diffusers;名稱反映它既有偏研究框架,也有文字轉影片版本。整體來看,這不是一般即開即用的消費級工具,但對需要靈活控制生成成本與效果的人,確有參考價值。