GordonChen19/Prompt-Relay 在 GitHub 上

GordonChen19/Prompt-Relay 在 GitHub 上

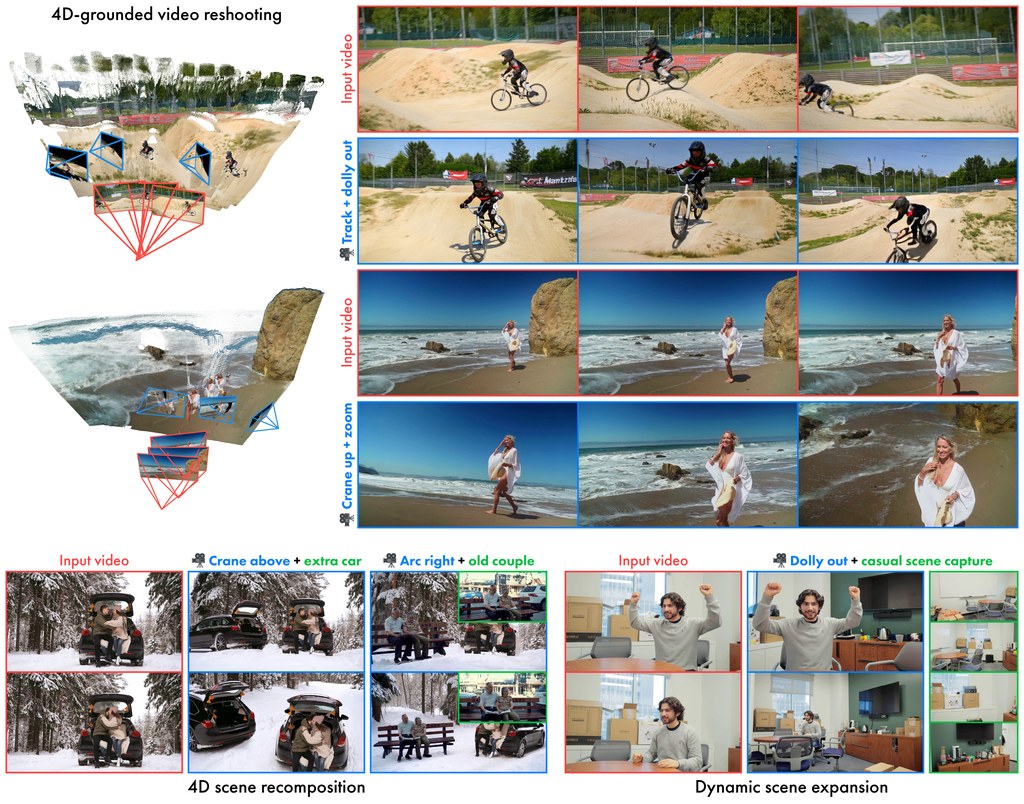

Prompt Relay 是一種令人信服的解決方案,適用於那些應對視頻生成中時間控制複雜性的挑戰。這種由 Gordon Chen、Ziqi Huang 和 Ziwei Liu 開發的推論階段方法,解決了當前視頻擴散模型中的一個重要缺口:管理視頻中多個事件的精確時間、持續時間和順序的能力。通過在交叉注意力機制中引入時間路徑先驗,Prompt Relay 確保每個提示被定位到其預定的片段,從而改善時間對齊、轉場自然性和視覺質量。這對於需要連貫敘事的應用特別有價值,例如電影級合成或詳細動畫。

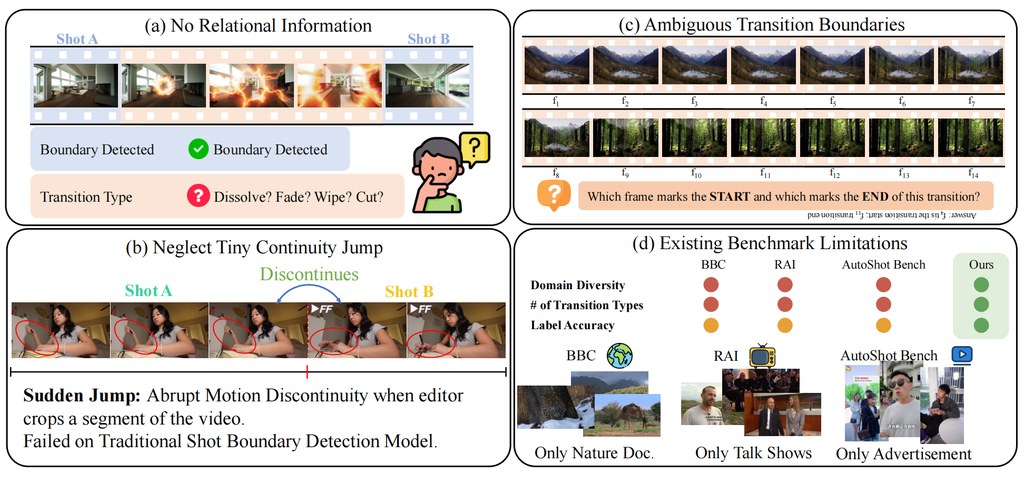

對於希望增強視頻生成能力的創作者和開發者,Prompt Relay 提供了一個簡單的起點。該方法專注於通過距離基於的懲罰修改交叉注意力機制,抑制潛在查詢和提示令牌在其指定區間之外的注意力。這種方法允許用戶在不需重新訓練基礎模型的情況下,微調視頻生成的時間方面。這種即插即用解決方案的簡單性意味著用戶可以快速將其整合到現有流程中,使其適用於廣泛的應用。

在實踐中,Prompt Relay 通過採用一個全局提示來條件整個視頻和一系列本地提示,每個本地提示對應一個特定的時間段。全局提示有助於在整個視頻中維持一致的角色、物件和場景上下文,而本地提示則為個別片段提供詳細指令。這種雙提示系統確保視頻的每個部分都由適當的指令引導,減少語義滲漏並改善整體一致性。用戶應專注於編寫清晰和具體的提示,以最大化這種方法的好處。

Prompt Relay 的創作者通過各種定性結果展示了其有效性。該方法顯著改善了時間對齊,確保每個事件在其預定的時間框架內發生。它還增強了轉場自然性,使不同事件之間的交接更為順暢和無縫。此外,Prompt Relay 通過最小化交叉注意力中的不必要的競爭,提升了視覺質量,從而實現更清晰和更穩定的多事件生成。這些改進在與基線提示策略和一些最近的強大模型如 Kling 3.0 相比時尤為顯著。

提示中繼功能改進:

- 時間對齊,即將每條指令限制在其分配的段落內。

- 透過確保事件在不同時間點之間的平穩交接,實現過渡的自然性。

- 透過減少不必要的注意力交叉競爭來提高視覺品質。

Prompt Relay 的性能始終優於基準提示策略,與Kling 3.0等近期推出的優秀模型相比也保持競爭力。尤其值得一提的是,Wan 2.2 + Prompt Relay通常比基礎 Wan 2.2 模型能夠產生更強大的視覺結構和更穩定的多事件。

| 指標(↓) | 索拉(故事板) | Kling 2.6 | Veo 3.1 | Wan 2.2 | Wan 2.2 + 即時中繼(我們的) |

|---|

| 時間對齊 | 4.67 | 1.30 | 3.93 | 4.00 | 1.10 |

| 過渡自然性 | 4.60 | 4.43 | 1.30 | 3.50 | 1.17 |

| 視覺品質 | 3.67 | 2.50 | 2.0 | 4.00 | 2.83 |

對視頻生成的時間方面進行精確控制的內容創作者、動畫師和開發者。例如,電影製作者可以使用這種方法創建更連貫和引人入勝的敘事線,而動畫師可以產生更順暢和詳細的動畫。需要注意的權衡包括編寫詳細提示的潛在複雜性和為實現最佳結果而需仔細校準距離基於的懲罰。用戶應嘗試不同的設置和提示結構,以找到適合其特定需求的最佳配置。

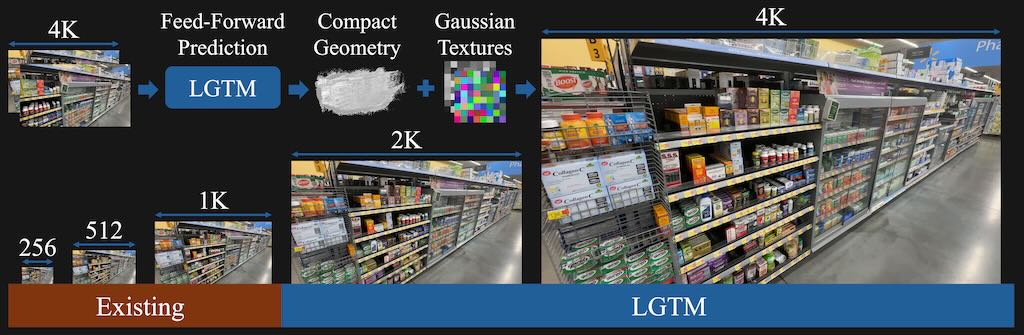

雖然 Prompt Relay 中使用的具體模型沒有明確提及,但似乎與各種視頻擴散模型兼容,包括 Wan 2.2。這種兼容性允許用戶利用不同模型的優勢,同時受益於 Prompt Relay 提供的時間控制。該方法的靈活性和易於整合性使其成為任何希望增強視頻生成能力的人的寶貴工具。通過應對時間控制的挑戰,Prompt Relay 為視頻合成領域的創意和技術應用打開了新的可能性。

總之,Prompt Relay 提供了一種實用且有效的解決方案,用於改善視頻生成中的時間控制。其簡單的實現和顯著的好處使其成為內容創作者和開發者的有吸引力的選擇。通過專注於編寫詳細的提示和仔細校準該方法的參數,用戶可以實現更連貫、自然和視覺上更具吸引力的視頻。儘管可能需要考慮一些權衡,但 Prompt Relay 的整體優勢使其成為任何視頻生成工具包的值得添加的內容。

Source: https://github.com/GordonChen19/Prompt-Relay/