OmniAvatar 是一種創新的音訊驅動全身視訊生成模型,它透過提高唇形同步精度和自然動作來增強人體動畫。 OmniAvatar 引入了一種逐像素多層音訊嵌入策略,可更好地捕捉潛在空間中的音訊特徵,從而增強不同場景下的唇形同步效果。為了在有效融合音訊特徵的同時保留基礎模型的提示驅動控制能力,我們採用了基於 LoRA 的訓練方法。大量實驗表明,OmniAvatar 在臉部和半身視訊生成方面均超越現有模型,能夠提供基於文字的精準控制,用於創建播客、人機互動、動態場景和歌唱等各個領域的影片。

HiDream 文生圖模型

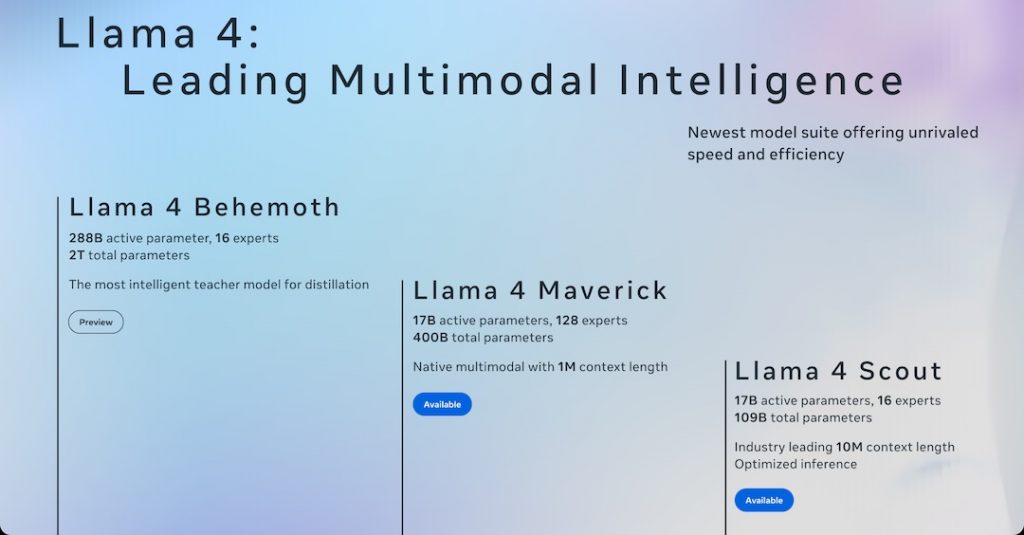

Llama 4 模型系列

Llama 4 Scout 是一個擁有 170 億個活躍參數和 16 個 MOE 的混合專家模型。它被認為是目前同類型最優秀的多模態模型,比前幾代的 Llama 模型更強大。新模型可以用單張 NVIDIA H100 GPU 運作。佢擁有業介領先的 1000 萬 tokens 上下文窗口,並且在廣泛使用的基準測試表現都優勝過 Gemma 3、Gemini 2.0 Flash-Lite 和 Mistral 3.1。它在預訓練和後訓練的過程都用了 256K 的上下文長度。

另一個模型 Maverick 同樣是一個擁有 170 億個活躍參數的模型,但它擁有 128 個 MOE 的混合專家模型。基準測試擊敗了 GPT-4o 和 Gemini 2.0 Flash,而在圖像方面亦表現相當出色,能夠將提示詞同埋相關的視覺概念對齊,將模型的回應鎖定到圖像中的特定區域。兩個模型都有獨特的活躍參數模式,能夠節省一半資源。令開發同應用的價格更低。

InfiniteYou 克隆自己

InfiniteYou 的獨特之處在於其強大的身份保留技術!透過核心組件 InfuseNet,即使在生成全新場景或是不同風格的相片,也能精準保留相片中的人物特徵。您可以僅以文字描述,就能讓同一人物出現在不同情境、穿著不同的衫,甚至呈現不同的風格。它亦支援 ControlNet 和 LoRA 的進階控制,令創意揮灑的同時,也能精細調整生成結果,直至符合您需要的獨特內容!(ByteDance)

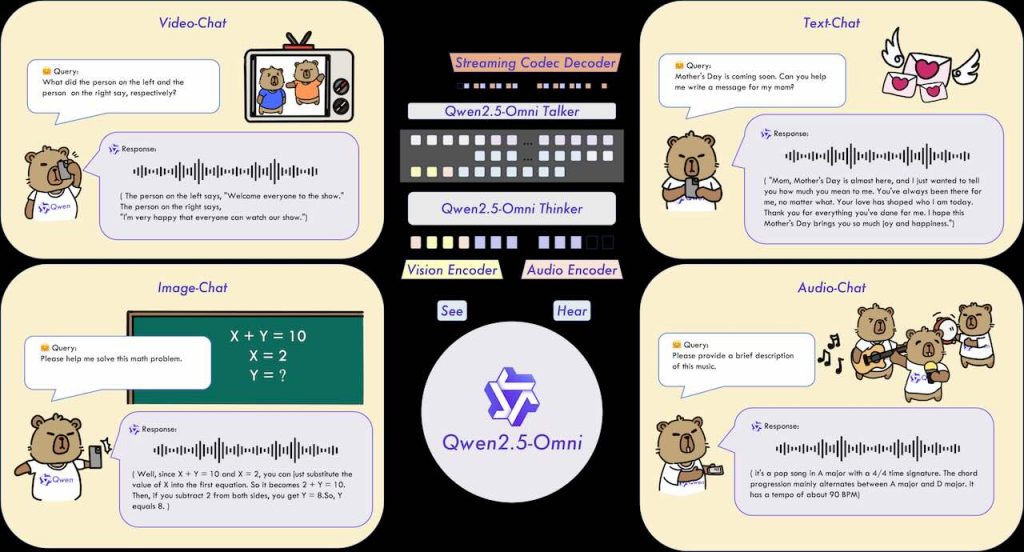

Qwen 2.5 Omni 7b 通義千問多模態模型

Qwen 2.5-Omni,是一個由阿里巴巴團隊開發的端對端多模態模型。它的主要目的是統一處理輸入的文字、圖像、音訊和影片,能同時生成文字和自然語音作為回應。模型在多模態輸入的感知、文字與語音的同步生成以及串流處理的優化等方面都採用了創新技術同埋架構,例如 TMRoPE 時間對齊編碼和 Thinker-Talker 架構。下面的影片詳細示範了 Qwen 在不同的應用場景下的優秀表現。

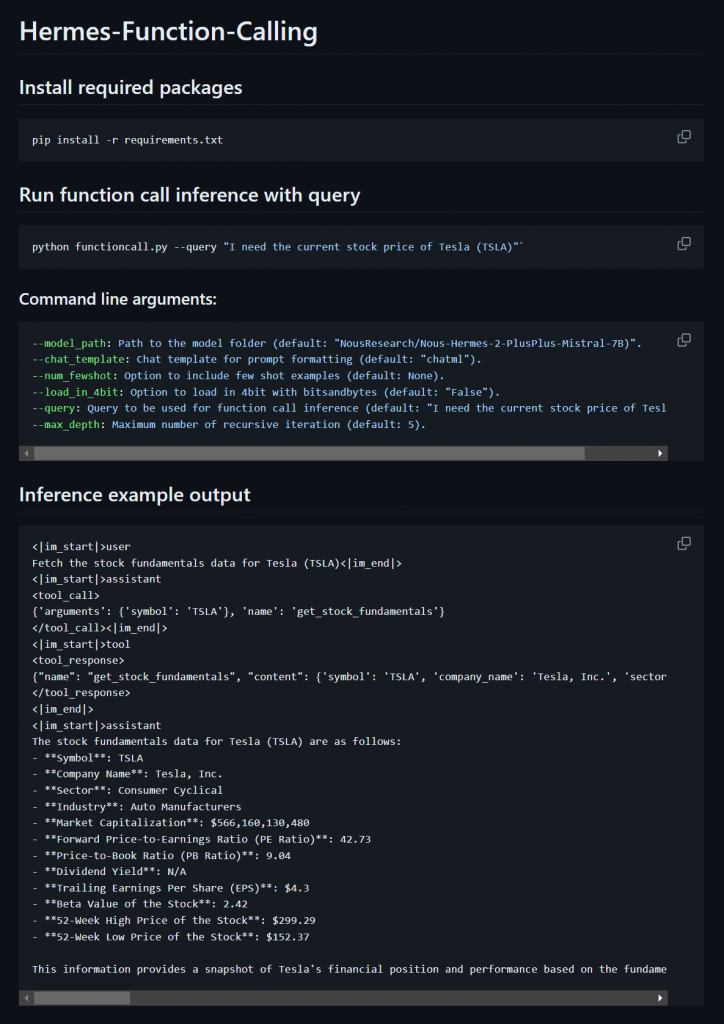

DeepHermes 3 內置推理的 LLM 模型

DeepHermes 3 Preview 是世界上第一批能夠將推理和正常 L L M 模式整合的模型之一。它包括高級的代理能力、更好的角色扮演、推理、能夠保持十分長的上下文連貫性對話。而且只要簡單的系統提示詞,就可以即刻啟動推理能力 Reasoning。

DeepSeek-R1 的強化學習可視化

影片主要講解 DeepSeek R1 模型背後的強化學習演算法,並著重於如何透過人類回饋來訓練獎勵模型。包括如何根據人類對不同回應的偏好來調整獎勵值。接著深入探討 “近端策略優化”(Proximal Policy Optimization)演算法的細節。同時亦探討如何利用 “優勢函數”(Advantage Function)避免偏離原始策略。最後,影片亦解釋了如何運用群體策略優化成高於平均水準的回應,同時亦阻止了低於平均水準的回應,而因此提升了模型的推理能力。

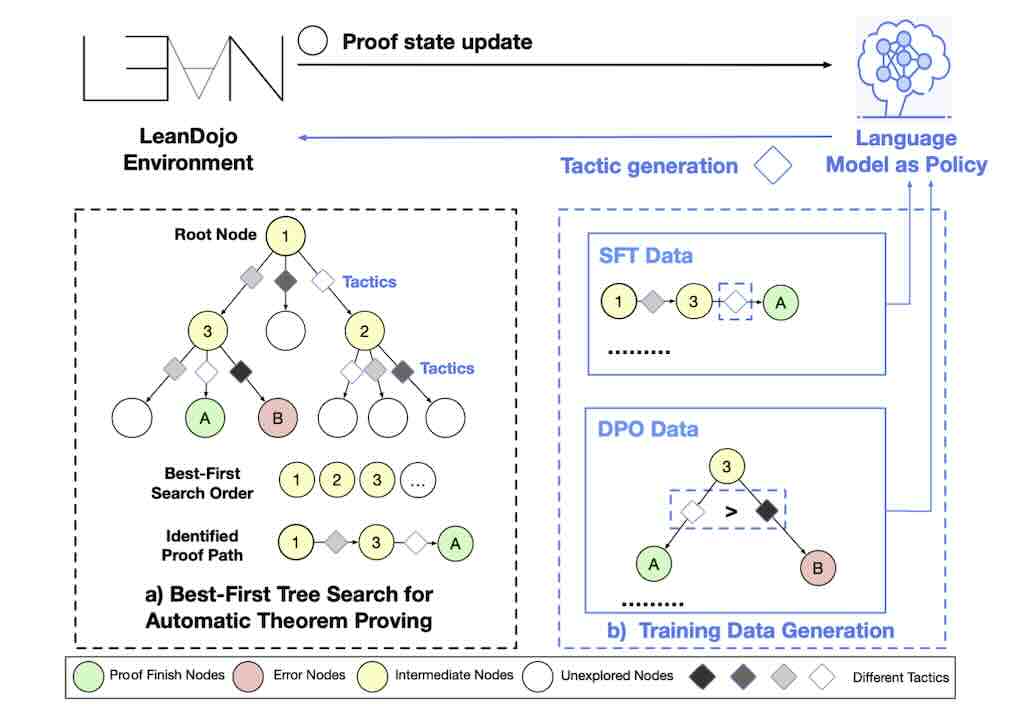

BFS-Prover 自動定理證明

最佳優先搜尋 (BFS Best-First Tree Search) 是一種樹狀搜尋演算法,它透過優先從機率最高的節點來運作,屬於簡單和效率演算法,但普遍認為對於證明定理並不是最理想的方法。 BFS-Prover 挑戰了傳統觀點,

提出一種可擴展的專家疊代框架,主要包含了三個創新點:一是策略性數據過濾,二是利用編譯回饋進行直接偏好優化 (DPO) Direct Preference Optimization,三是長度正規化。

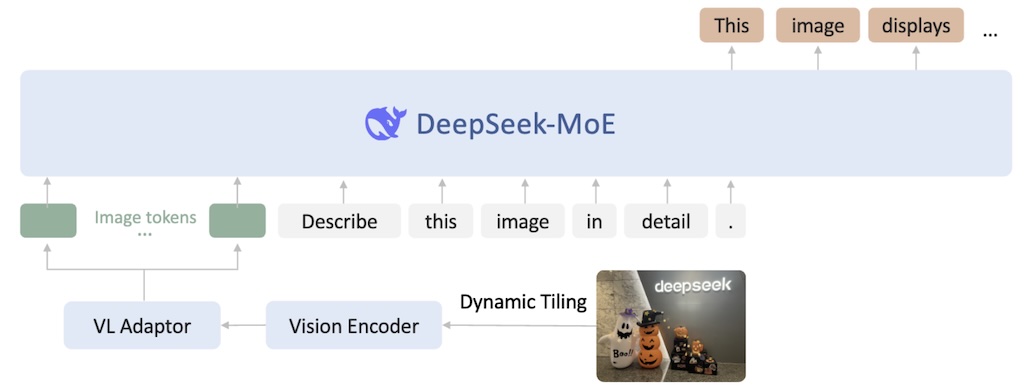

Deepseek – VL2 視覺模型

DeepSeek-VL2 使用 MoE 混合專家 Mixture-of-Experts 的視覺語言模型,主要在於提升多模態理解能力。DeepSeek-VL2 在視覺問答、光學字元識別、文件理解和視覺基礎等方面表現出色。模型包含三個版本:Tiny、Small 和 Base,並提供了模型下載、Gradio web 介面範例。

ACE++ 圖像生成與編輯任務

ACE++ 基於指令的擴散框架,只要輸入一張圖像即可生成與角色一致的新圖像,專門用來處理各種圖像生成和編輯任務。靈感來自 FLUX.1-Fill-dev 的輸入格式,以雙階段訓練方法來減少對圖像擴散模型進行微調所需的工作量。這框架提供了全面的模型集,涵蓋了完整微調和輕量級微調,在生成圖像品質和遵循提示能力方面展現了卓越的性能,可以廣泛應用於人像一致性、靈活指令描述和局部編輯等不同情境。