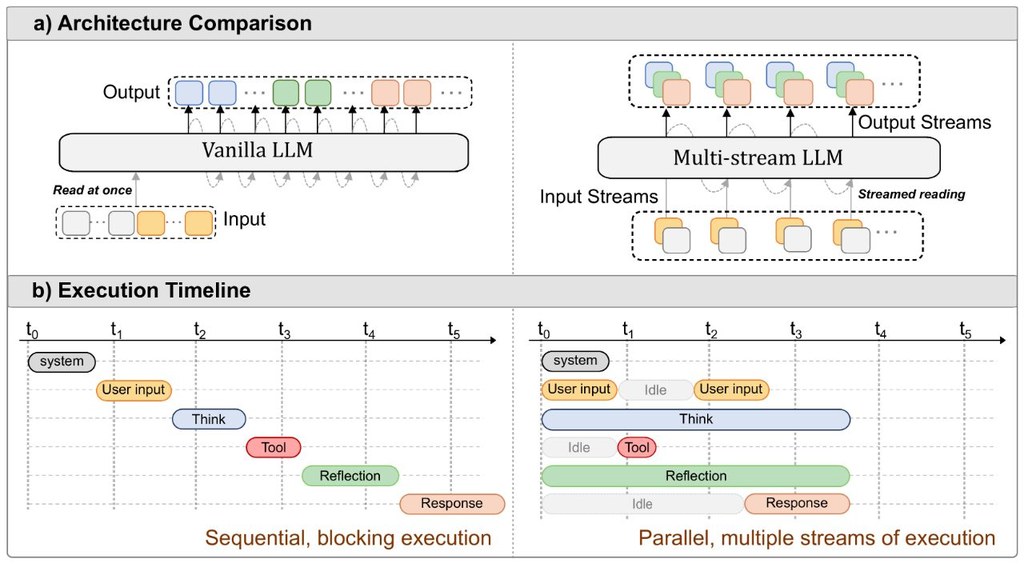

seal-rg/streaming 是一個研究型專案,核心概念是令大型語言模型不再只按單一路徑逐步讀、想、答,而是把輸入、推理過程與輸出拆成多條「stream」並行處理。對一般讀者來說,可以理解成模型一邊讀題、一邊解題,甚至另一條路同時做檢查,減少傳統逐字等待的阻塞感。

實際使用上,這個儲存庫不是即開即用的聊天工具,而是分成三個可獨立運行的實驗資料夾,分別研究效率、安全性及可監察性。若你是研究員或工程團隊,可以按目標選擇對應部分,例如想測試「邊讀邊答」就看效率章節,想研究提示攻擊防護則集中安全章節。

它最有意思的創新,在於多串流共用權重的設計:不是為每條思路各自建一個完整模型,而是在同一模型內並行安排多個資訊通道。README 顯示它涵蓋 2、3 甚至 10 個 streams,並把思考、使用者輸入與模型輸出拆開處理;其中較大型版本還提到每個 stream 的 Gated-DeltaNet 狀態,顯示作者不只追求速度,亦想提升內部行為的可觀察程度。

- 三個重點面向:效率、安全、可監察性

- 相關模型包括:Qwen2.5-7B、Qwen3-1.7B、Qwen3-4B、Qwen3-8B、Qwen3.5-27B

- 已知實驗名稱包括:Stream-8B、Stream-27B

- 評估任務涵蓋 GSM8K、MATH500、SQuAD、PubMedQA、TensorTrust、IFEval 等

最適合的應用場景,是想研究下一代 LLM 推理流程的人,而不是只想部署一般客服機械人。特別是需要同時兼顧回答速度、抗攻擊能力,以及想更清楚監察模型「正在怎樣想」的團隊,這個專案提供了相當具體的實驗框架;不過它主要仍屬研究代碼,實際產品化前應預期要自行整合與驗證。

使用方法

這個模型需要 自定義推理代碼(標準 Hugging Face Transformers 不能直接支援 Multi-Stream 格式),推薦使用官方推理代碼。