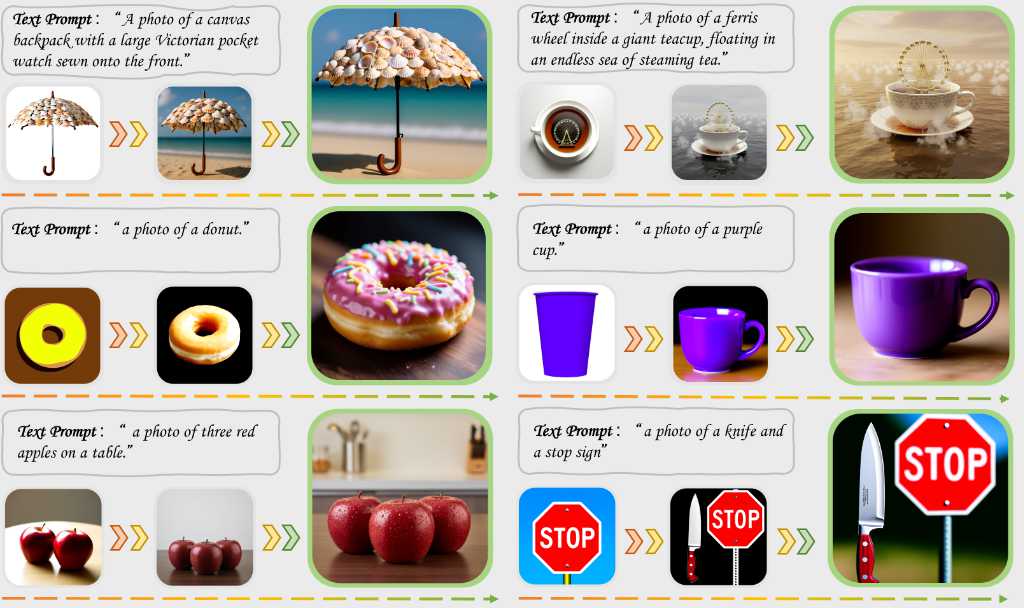

CoF-T2I 模型透過漸進式視覺細化,將 CoF 推理整合到 T2I 生成過程中,其中中間幀作為顯式推理步驟,最終幀作為輸出。為了建立這種明確生成過程,CoF-T2I 建立了CoF-Evol-Instruct 資料集,該資料集包含從語義到美學的 CoF 軌跡,用於建模生成過程。為了進一步提高品質並避免運動偽影,CoF-T2I 對每一幀都進行了獨立編碼。實驗表明,CoF-T2I 的性能顯著優於基礎視訊模型,並達到了具有競爭力的水平。

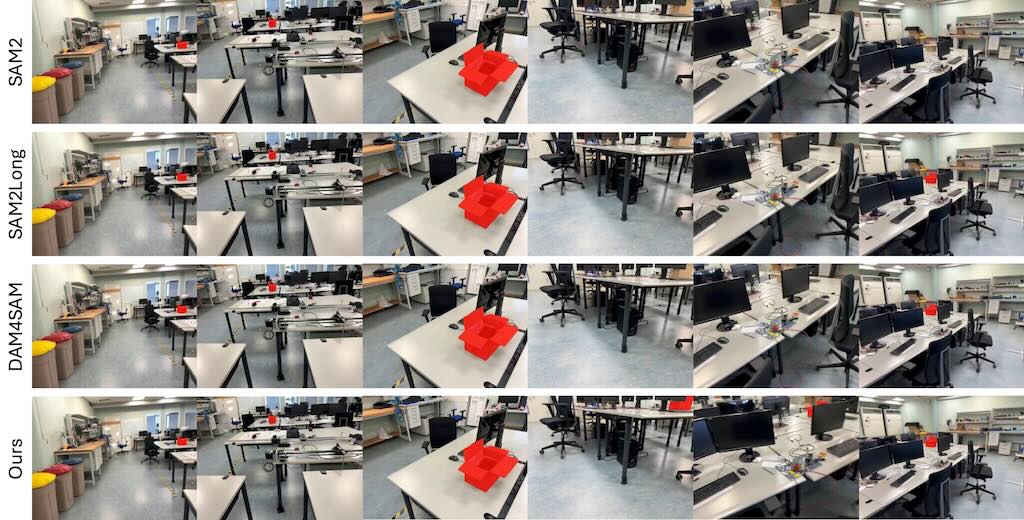

3AM 是一種結合了 2D 即時分割模型 SAM2 與 3D 幾何資訊的方法,目的是在影片或任意多視角圖像集合中,對同一物體保持一致的分割 mask。傳統的 2D 追蹤模型(如 SAM2)在觀點大幅變化時會因為只能依賴外觀特徵而失去目標,而早期的 3D 方法則需要提供相機位姿、深度圖或複雜的前處理,才能保證跨視角的一致性。

3AM 的創新在於在模型訓練階段,透過輕量的特徵合併模組把從 MUSt3R(一個多視角重建模型)學到的隱式幾何特徵與 SAM2 的外觀特徵結合,形成既能捕捉空間位置又能反映視覺相似度的表示。這樣的融合讓模型在推論時只需要原始 RGB 影像和使用者提供的提示(點、框、mask 等),就能在不同觀點之間追蹤物體,且不需要額外的相機資訊或前處理步驟。文章指出,這種做法在包含大量視角變化的基準測試集(如 ScanNet++、Replica)上,IoU 數值提升顯著,例如在 ScanNet++ 的 Selected Subset 上比 SAM2Long 高出約 15.9 個百分點。整體而言,3AM 在保持即時、可提示化的特性同時提升了跨視角的一致性,為後續的 3D 實例分割與多視角物體追蹤提供了一個更簡單、更有效的解方案。

VINO 是個統一的視覺生成工具,能同時處理圖像和影片的創作與編輯,無需針對每種任務去找不同的模型。它的核心架構是把視覺語言模型和多模態擴散轉換器(MMDiT)結合起來,讓文字、參考圖片或影片都能以同一套條件流動的方式被傳遞給擴散過程。

這裡的「可學習查詢 token」扮演的角色是把使用者的簡短指令轉化成模型能理解的細節向量,並在訓練時一起調整,讓指令更精確、模型更穩定。另一個關鍵在於把參考影像或影片所產生的特徵與它在 latent 空間的對應向量用同樣的開始與結束標記包起來,這樣模型就能在語意層面和潛在層面都把同一個參考資源針對地辨識出來,減少身份混淆或屬性遺漏的問題。

InfiniDepth 把傳統的深度圖想成一個可以在任何二維座標上即時查詢的隱式場(Implicit Field),而不是固定在像素格子裡。這樣的表示方式讓模型不再受到訓練解析度的限制,能夠直接輸出任意高解析度的深度圖,同時保留更細緻的幾何細節。

NeoVerse 是一種強大的 4D 世界模型,專門設計來處理現實環境中的單眼視頻,從而實現多種應用。這個模型的核心優勢在於它能夠進行無姿態限制的前饋 4D 重建,這意味著它可以從普通的單眼視頻中直接生成高質量的 4D 場景,而不需要複雜的多視角數據或預處理步驟。

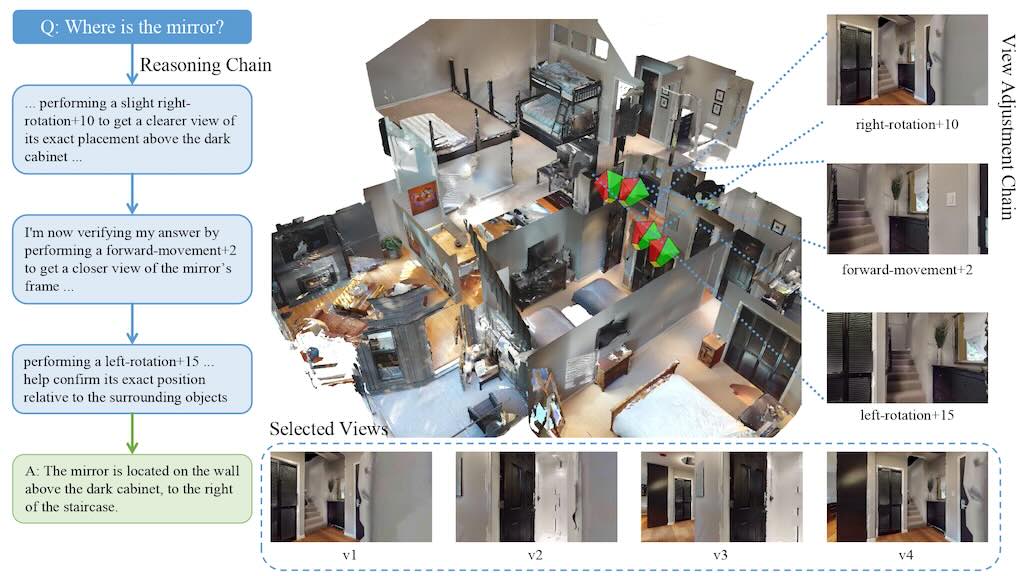

CoV (Chain-of-View Prompting for Spatial Reasoning) 可以用於各種需要在複雜三維環境中進行精確空間理解的場景。例如 VR 和 AR,CoV 可以幫助系統更好地理解和響應用戶在虛擬環境中的查詢,提供更自然、更沉浸式的體驗。在自動駕駛領域,CoV 可以增強車輛對周圍環境的理解能力,提高其在複雜道路條件下的導航和決策能力。

CoV 提出一種創新方法,專門針對在三維環境中的具身問答(Embodied Question Answering, EQA)問題。傳統的視覺語言模型(Vision-Language Models, VLMs)受限於固定的輸入視角,這使得它們在推理過程中無法動態地獲取與問題相關的上下文信息,進而限制了複雜空間推理的能力。CoV 通過引入一種免訓練、僅在測試階段運行的框架來解決這一問題,該框架能夠讓 VLMs 變成主動的視角推理器。

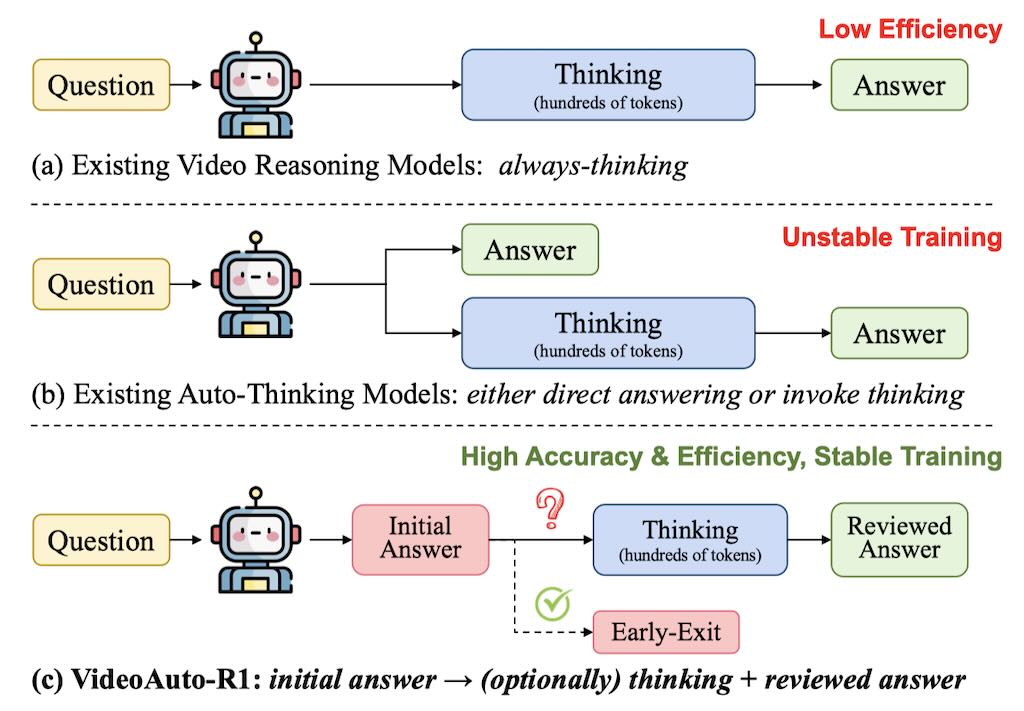

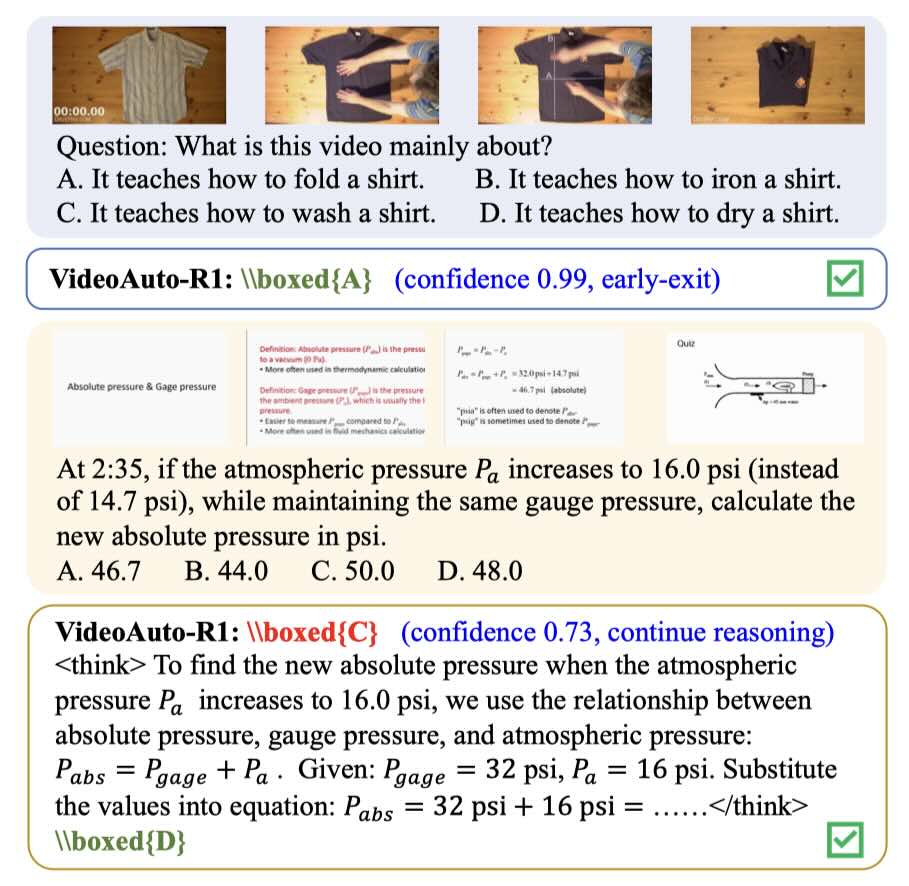

VideoAuto-R1 採用了一種「當需要時才推理」的策略。這種策略在訓練階段遵循「一次思考,兩次回答」的範式,即模型首先生成一個初步答案,然後進行推理,最後輸出一個經過審核的答案。這兩個答案都通過可驗的獎勵進行監督。在推理階段,模型使用初步答案的置信度分數來決定是否繼續進行推理過程。Meta 在 VideoAuto-R1 專案中扮演研究合作與工程貢獻角色。

1. 視頻問答系統:VideoAuto-R1 可以應用於各種視頻問答任務,提高系統在理解和回答視頻內容方面的準確性,同時降低計算成本。

2. 教育與培訓:在線教育平台可 leverage 這種技術來提供更智能的學習助手,幫助學生理解複雜的視頻內容,並根據需要提供針對性的解釋。

3. 互動式媒體:增強視頻內容的互動性,例如通過自動推理來回答用戶關於視頻內容的問題。

4. 智能監控:在安全監控系統中,VideoAuto-R1 可以用來分析和解釋監控視頻中的活動,從而提高安全性和監控效率。

5. 自動化客戶服務:在客服領域,該技術可以幫助自動化回答客戶關於產品或服務視頻的問題,提供更個性化的客戶體驗。

6. 內容創作與編輯:視頻創作者可以利用這種技術來自動化地生成視頻描述和解釋,從而簡化內容創作和編輯過程。

7. 多模態學習和研究:VideoAuto-R1 作為一種多模態理解技術,可以促進自然語言處理和電腦視覺領域的研究。

「Qwen3-VL-Embedding-2B」是 Qwen 家族中最新的多模態信息檢索和交叉模態理解模型。可在同一向量空間做相似度計算,方便做「跨模態檢索」與「圖文混合檢索」。

Embedding 維度可控:預設最高 2048 維,但支援使用者自訂輸出維度 64–2048,可依儲存成本與下游模型需求調整(例如 256/512 維用於向量 DB)。

模型規模與 context length:2B 參數,context 長度 32k,適合放在邊緣或低資源伺服器上,同時能處理長文檔、多 frame 影片描述等輸入。

| 模型 | Gemini Multimodal Embeddings | Qwen3-VL-Embedding (2B/8B) |

|---|---|---|

| 模態支援 | 文字、圖片、video(含 audio 軌道,1 FPS + 音頻特徵) | 文字、圖片、截圖、video(多 frame),混合任意組合 |

| 語言 | 多語(英文主導) | 30+ 語言,強中文/多語對齊 |

| 維度 | 固定 1408 | 可自訂 64–4096(預設 2048) |

| Context | Video 上限 1-3 小時 | 32K tokens(長影片多 frame) |

| 開源 | 否(API) | 是(HF/GitHub,Apache 2.0) |

| 成本 | $0.0001/1000 chars(text),更高 video/image | 免費本地,GPU 硬體成本 |

| 整合 | Vertex AI / Gemini API,易 scale | Transformers/vLLM,量化友好 |

PlenopticDreamer 主要解決「鏡頭控制生成影片」的不一致問題。這是一個能讓 AI「像無人機一樣繞著物體飛」生成影片的技術。它可以應用在自駕車的模擬環境、機器人的視覺訓練,以及好萊塢等級的虛擬拍攝。

1. Robotics(機器人):

* 情境模擬: 機器人需要理解物體在不同角度下的樣貌。這個技術可以根據單一攝影機的畫面,生成該物體在其他視角的影像,幫助機器人進行視覺導航或物體抓取的訓練。

* 模擬數據生成: 為機器視覺系統生成更多樣化的訓練數據。

2. Self-Driving(自駕車):

* 場景理解: 自駕車通常有多個鏡頭。這個技術可以補足盲區,或者將一個鏡頭的畫面轉換成其他鏡頭的視角,幫助車輛更全面地感知周圍環境。

* 未來幀預測: 預測道路上物體在下一秒鐘會出現在哪個位置(從不同角度)。

3. 影視製作與 AR/VR:

* 新視角補全: 如果拍攝時漏掉了某個角度,可以利用這個技術「憑空生成」該角度的連續影片。

* 重定向(Re-direction): 可以將拍好的影片,根據新的鏡頭軌跡重新渲染(Re-rendering),讓同一段故事可以從不同角度重新看一遍。

SpaceTimePilot 是一個把「攝影機運鏡」和「時間軸控制」徹底拆開來玩的視覺生成模型,從一支普通的單眼影片出發,就能同時改變鏡頭路徑和動作節奏,做出 bullet-time、慢動作、倒帶、甚至空間與時間交錯前進這種高自由度效果。 過去的 Camera-control V2V 模型(例如 ReCamMaster、Generative Camera Dolly)只能改鏡頭、不能動時間;4D 多視角模型(如 Cat4D、Diffusion4D)雖支援時空條件,但通常只給離散片段,沒辦法連續、細緻地玩時間線。 SpaceTimePilot 最大的賣點,就是讓「鏡頭怎麼走」和「畫面播到第幾秒」變成兩條獨立的控制軌,創作者可以像在 3D 時空中開飛機一樣,自由規劃路線。

為了做到這件事,作者先在 diffusion 裡加了一個專門描述「動畫時間」的 time-embedding 機制,讓模型能精確理解「現在這一幀應該是原影片第幾秒、第幾個動作狀態」;接著用 temporal warping 資料增強,把既有多視角資料集重新時間扭曲,模擬快轉、倒帶、停格等不同節奏,強迫模型學會把「場景動作」和「攝影機移動」拆開學。 他們還自建了一個 Cam×Time 合成資料集,對同一個場景做出「攝影機 × 時間」的全格點渲染,總共 10 萬級場景時間組合,給模型完整的時空監督,讓 bullet-time 這種超細膩的時間控制可以穩定、不抖動地跑出來。 在推理端,SpaceTimePilot 透過自回歸(autoregressive)推進,把一段段 81 幀的生成片段接起來,不但能長時間探索,也能在多輪生成中維持鏡頭、時間與內容的一致性,對影視特效、互動體驗、AR/VR 內容創作來說,是非常實用的一條未來工作流路線。(劍橋 與 Adobe 聯合開發)