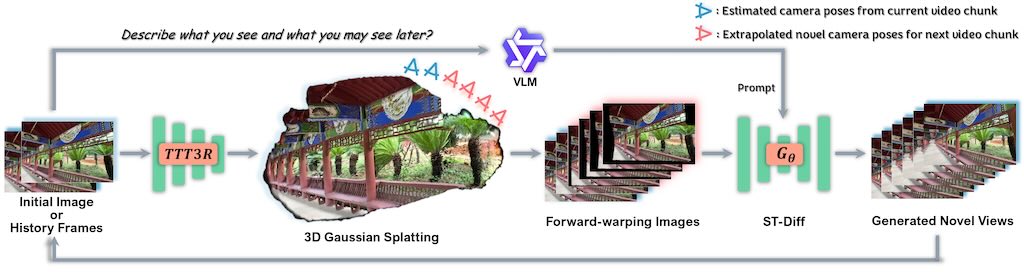

VerseCrafter 是一套以 4D 幾何控制驅動的影片擴散模型,目標在單張參考圖上同時掌控相機運動與多目標的三維軌跡,讓生成的影片在視角變化與物體遷移間保持高度一致。讓使用者能夠像操控遊戲或電影一樣,精確控制鏡頭和物體的運動,從而生成逼真的動態影片。

一般的 AI 影片模型通常難以同時掌控鏡頭移動和多個物體的動作,VerseCrafter 透過一種全新的表示法解決這個問題:1. 動態世界模擬:它不只是畫出一連串的畫面,而是先在一個隱藏的 3D 空間中建立場景的基礎結構(例如背景點雲),然後加上時間軸,變成 4D。2. 精準控制:鏡頭:你可以指定鏡頭要怎麼飛行(例如從左邊飛到右邊,或是繞著物體旋轉)。你甚至可以指定畫面中的物體要如何移動、旋轉。