Qwen3.5-Omni 是 Qwen 最新一代全模態大模型,支持文本、圖片、音頻、音視頻理解。結構上,Qwen3.5-Omni 的 Thinker 與 Talker 均採用 Hybrid-Attention MoE 架構。Qwen3.5-Omni 系列包含 Plus、Flash、Light 三種尺寸的 Instruct 版本,支持 256k 長上下文,模型支持超過 10 小時的音頻輸入及超過 400 秒的 720P(1 FPS)音視頻輸入。模型在海量文本、視覺以及超過 1 億小時的音視頻數據上進行原生多模態預訓練,該模型展現出卓越的全模態感知與生成能力。相比 Qwen3-Omni,Qwen3.5-Omni 多語言能力大大增強,能夠支持 113 種語種和方言的語音識別和 36 種語種和方言的語音生成。目前可通過 Offline API 和 Realtime API 進行體驗。

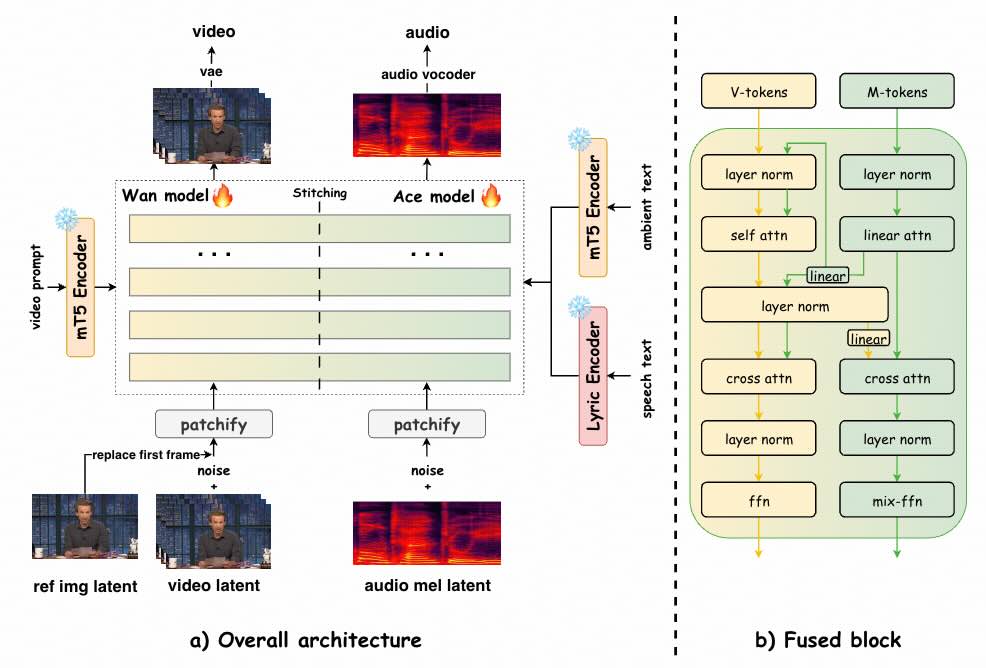

Qwen3.5-Omni Thinker 通過 Vision Encoder 和 AuT 接受視覺和音頻信號輸入,音視頻信號通過 interleave 交織並搭配 TMRoPE 編碼位置信息。Thinker 負責處理全模態信號並輸出文本,Talker 負責接收來自 Thinker 的多模態輸入以及文本輸出,進行 contextual 語音生成,語音表徵通過 Qwen3-Omni 提出的 RVQ 編碼來替代繁重的 DiT 運算。由於 chunk-wise 的流式輸入設計和流式 Talker 設計,整個模型可以進行 realtime interaction。不同於上一代 Qwen3-Omni 的雙軌 Talker 輸入,Talker 在輸入的組織方式上採用了 ARIA(自適應速率交錯對齊,Adaptive Rate Interleave Alignment)來動態對齊文本與語音單元,然後進行交錯排布,以避免由於文本與語音 Token 編碼效率差異導致的語音不穩定性,如漏讀、誤讀或數字發音模糊等問題。