【漫士科普】90分鐘深度!一口氣看明白人工智能和神經網絡的講稿節目,由一位清華大學姚班人工智能博士生「漫士」主講。影片以淺顯易懂的方式,從 1956 年的達特茅斯會議——人工智能的起源——開始,循序漸進地解釋人工智能、機器學習和神經網絡的基本原理和發展脈絡。講稿涵蓋了三大 AI 流派:符號主義、聯結主義和機器學習,並深入淺出地闡述了感知機、多層感知機、卷積神經網絡、殘差網絡和 Transformer 等模型的演進,以及梯度下降和反向傳播算法在訓練神經網絡中的核心作用。 最後,影片探討了人工智能的泛化能力、局限性以及對就業市場的潛在影響,並鼓勵觀眾積極學習,適應AI時代的變化。 總體而言,這段文字旨在普及人工智能相關知識,幫助零基礎觀眾理解這項前沿技術的來龍去脈。

Kling 1.6 如何指揮電影

在 Kling 1.6 中指揮電影 Ai 攝影機所需了解的一切。您將在新的 Kling 中學習如何根據提示控制相機移動。

M4 Mac mini + Ollama 輕量級 AI 服務器

M4 Mac mini 很適合作為輕量級AI服務器。也就溫熱程度,全程靜音!

ScrapeGraphAI 開啓智能數據抓取新時代!

用AI重塑數據提取方式!ScrapeGraphAI + LangChain + LangGraph 打造最強文章採集和寫作AI智能體!讓內容創作更簡單!

bolt.diy 生成式網頁設計

bolt.diy 允許使用者使用任何大型語言模型 (LLM) 來建立、執行、編輯和部署全端網頁應用程式。它支援多種 LLM,例如 OpenAI、Anthropic 和 HuggingFace 等,並具備可擴展架構以支援更多模型。這裡包含專案的安裝說明、使用方法、支援的 LLM 列表、以及社群參與和未來發展規劃等資訊,目標是提供一個方便易用且高度彈性的 AI 程式碼輔助工具。

![]()

Hunyuan 影片生成詳解

Fast Video Framework 大幅提升本地 AI 影片生成速度,同時維持高畫質。 透過 LCM 取樣和 LoRA 整合,讓 Hunyuan Video 和 Mochi One Preview 等模型在一般家用電腦上也能快速運作,並減少資源消耗。 片中以 ComfyUI 為例,逐步示範如何設定與使用,包含壓縮儲存、整合 LoRA 模型等步驟,讓使用者能輕鬆高效生成各種風格的影片。

ComfyUI Flux 模型換衫教學

它能利用兩個新的 Flux 模型(Flux Fill 和 Flux Redux)將衣服穿戴在人物模型上。能精準且智慧地將各種服飾,例如襯衫、褲子、鞋子、眼鏡和帽子等,甚至多件服飾同時,完美地套用到圖片中的人物身上,實現以往難以達成的穿衣效果。

免費 AI 工具拍攝史詩電影![ComfyUI 教程 + 免費工作流程]」

影片作者 Mickmumpitz 展示如何利用 ComfyUI,以及幾個開源 AI 影像模型 (例如 Co video x, LTX Video, Machi 1, Hyan),將自家拍攝的影片轉化成具有電影感的史詩級畫面。影片重點在於如何使用這個 AI 工作流程,包含設定、模型選擇 (不同模型各有速度與畫質的優劣)以及控制網路 (Control Net) 的應用,以達到精準控制影像生成的目標,例如保留演員表情和動作,或轉換角色外貌。影片也提供免費及付費兩種工作流程,付費版本提供更進階的功能,例如臉部替換和更精細的畫面調整。最後,作者展示了一部以這個方法製作的短片,說明其應用實例。

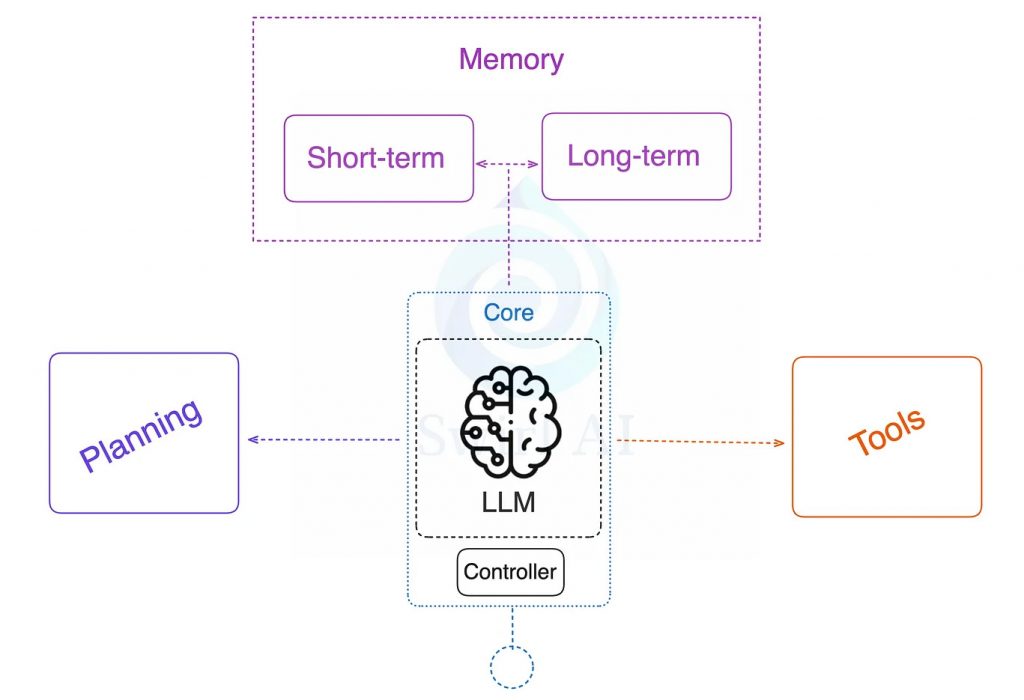

從零開始構建一個 AI 代理

ComfyUI 上使用 Hunyuan 影片模型

騰訊開源模型 Hunyuan (混元) 能生成高品質 AI 影片,具有出色的動作穩定性、場景切換和逼真的視覺效果。ComfyUI 官網介紹了如何免費使用「Hunyuan Video」模型首先必需安裝幾個主要檔案:

hunyuan_video_t2v_720p_bf16.safetensors(主要的影片生成模型) 放入 -> ComfyUI/models/diffusion_models/

clip_l.safetensors放入 -> ComfyUI/models/text_encoders/

llava_llama3_fp8_scaled.safetensors(文字編碼器) 放入 -> ComfyUI/models/text_encoders/

hunyuan_video_vae_bf16.safetensors(變分自動編碼器 VAE) 放入 -> ComfyUI/models/vae/

模型亦支援生成靜態圖片,只需將影片長度設定為 1 即可。最後亦提供了一個 JSON 格式的工作流程範例,方便使用者快速上手。