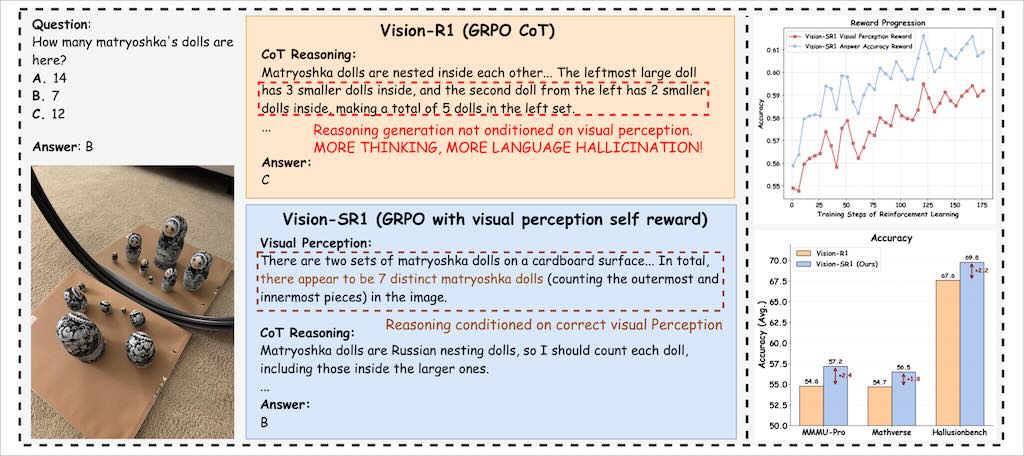

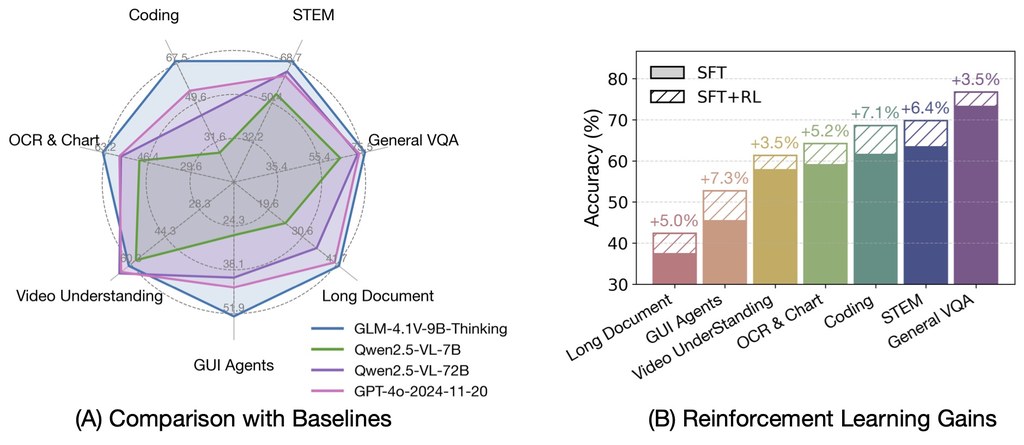

GLM-V儲存庫提供了一系列視覺語言模型(VLMs),旨在應對複雜的人工智慧挑戰。研究人員、開發者和AI愛好者若想推動多模式推理的邊界,應該考慮使用GLM-4.6V、GLM-4.5V和GLM-4.1V進行實驗。這些模型在各種任務中表現出色,從圖像和視頻理解到GUI操作和文件分析。對於新手來說,最初專注於GLM-4.5V模型是明智的選擇,因為它具有穩健的性能和全面的文檔。這個模型作為一個堅實的基礎,在深入研究GLM-4.6V的更先進功能之前。

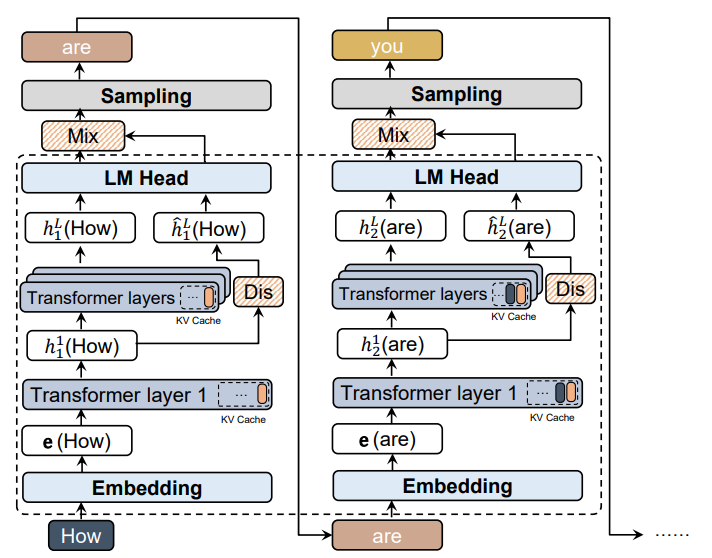

在實際應用中,GLM-V模型通過無縫整合視覺和文本數據來運行。它們可以解釋複雜的場景,理解複雜的文件,甚至協助處理GUI任務。例如,GLM-4.6V模型支持高達128k令牌的上下文窗口,使其能夠高效地處理廣泛的多模式輸入。這種能力使它特別適用於需要長上下文理解的任務,如分析研究報告或處理長篇文件。該模型的原生多模式函數調用功能進一步增強了其實用性,允許直接與視覺元素互動而不需要中間文本轉換。

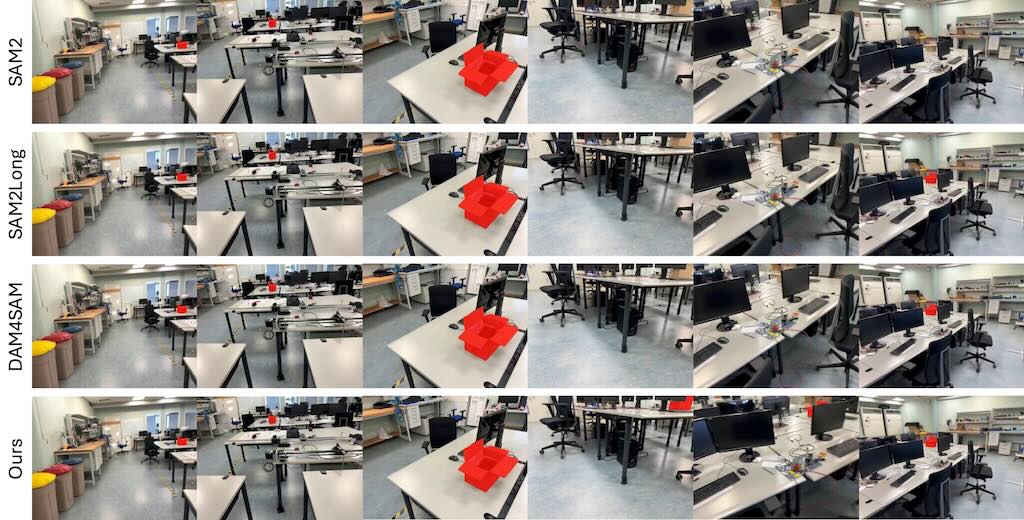

開發者和企業最受益於這些模型自動化複雜任務和改進決策過程的能力。例如,GLM-4.5V的思考模式切換允許用戶在快速響應和深度推理之間切換,滿足多樣化的需求。這種靈活性在現實世界應用中非常寶貴,那裡速度和準確性必須平衡。此外,儲存庫中包含的桌面助手應用展示了實際用例,例如從PC螢幕捕捉視覺資訊並在各種場景中提供智能服務。

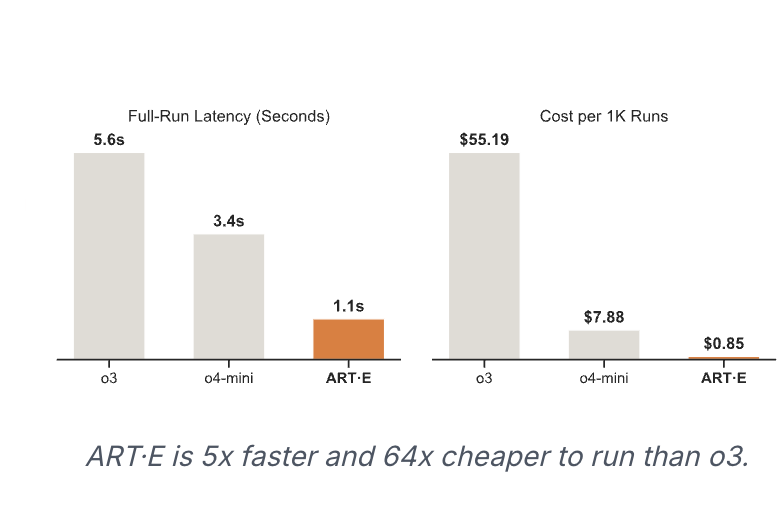

然而,也有一些權衡需要考慮。儘管GLM-V模型提供了令人印象深刻的性能,但它們需要大量的計算資源,特別是對於較大的GLM-4.6V模型。使用者應確保其硬體能夠應對這些模型的需求,以避免性能瓶頸。此外,這些模型的純文本QA能力仍有改進空間,因為目前的重點主要在視覺多模式場景上。開發者可能會遇到偶爾的問題,如重複的思考輸出或格式錯誤,這可能會影響用戶體驗。

為了最大化GLM-V模型的潛力,使用者應熟悉所提供的示例和文檔。儲存庫包括GUI代理和桌面助手的演示,提供關於提示構建和輸出處理的見解。這些示例作為優秀的起點,將GLM-V整合到現有工作流程或開發新應用中。藉助這些資源,開發者可以釋放GLM-V模型的全部潛力,並為推進智能系統領域做出貢獻。

無論你是研究人員探索最新的VLM技術,還是開發者尋求自動化複雜任務,GLM-V都提供了寶貴的解決方案。然而,使用者應當注意計算需求和當前限制。經過仔細考慮和策略應用,GLM-V模型可以顯著提升人工智慧驅動項目的性能和智慧水平。

Source: https://github.com/zai-org/GLM-V