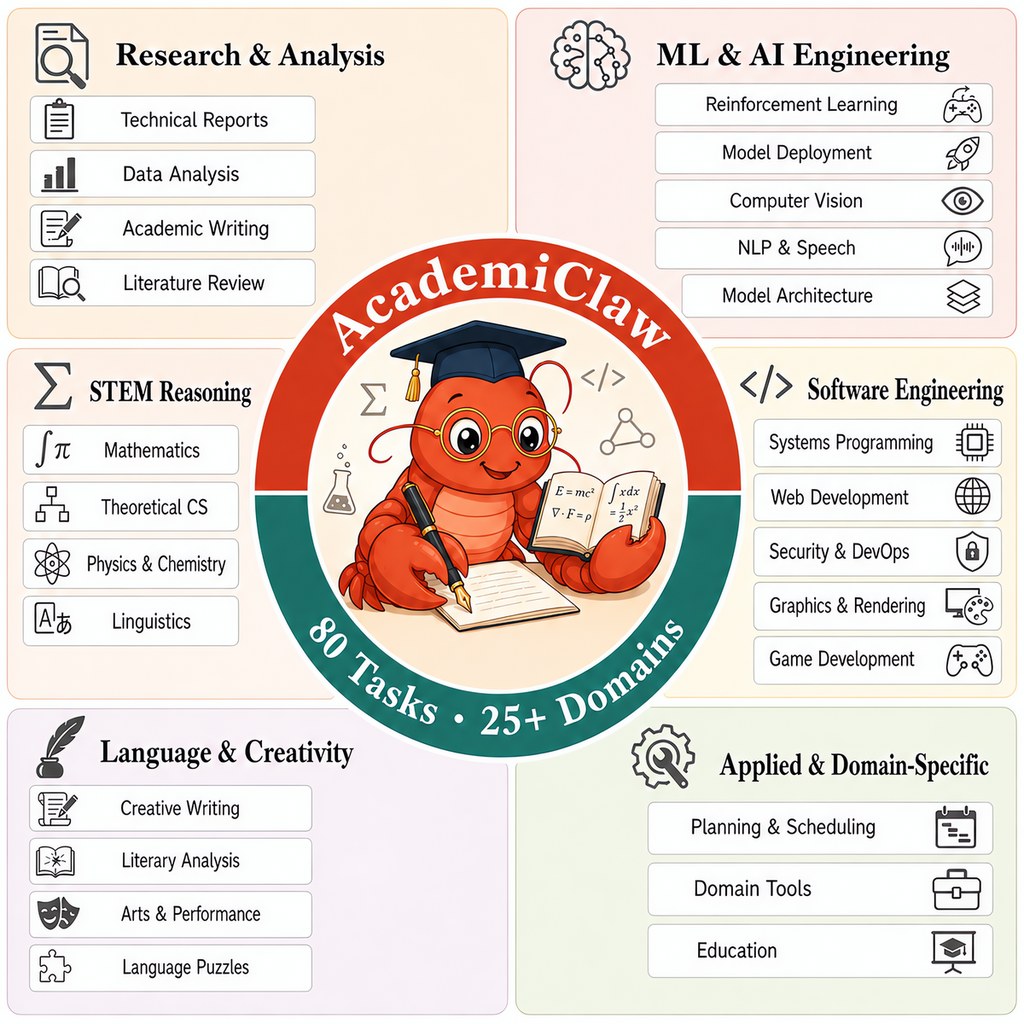

AcademiClaw 包含80個大學生的學術任務雙語基準測試 為AI代理呈現了一項獨特的學術 挑戰,透過使用真實世界的學術任務。這80個任務直接來自學生,突顯了當前AI不足之處。

該基準測試涵蓋了各種類別,如研究、軟體工程和語言創意,確保了全面的測試。研究人員和開發者可以專注於這些類別,以識別AI的優勢和弱點。每個任務都經過精心設計,並進行多維度評估,增強其可靠性。

在實際應用中,AcademiClaw 使用CPU和GPU任務的混合,根據需求自動路由。這種設置確保了在測試不同AI模型時的可重現性和公平性。用戶從詳細的評分維度和安全審核中受益,提供了對模型性能的洞察。

教育工作者和AI研究人員將發現 AcademiClaw 對於提升AI能力極具價值。它需要能夠處理複雜、長時間範圍任務的強大LLMs。

主要收穫:

– AcademiClaw 使用真實的學生挑戰來測試AI。

– 它涵蓋了多樣化的學術領域,並進行詳細評估。

– 需要堅固的LLMs才能有效完成任務。

– 為AI開發和教育提供寶貴的見解。

– 支援CPU和GPU任務,以實現靈活的測試。