CoV (Chain-of-View Prompting for Spatial Reasoning) 可以用於各種需要在複雜三維環境中進行精確空間理解的場景。例如 VR 和 AR,CoV 可以幫助系統更好地理解和響應用戶在虛擬環境中的查詢,提供更自然、更沉浸式的體驗。在自動駕駛領域,CoV 可以增強車輛對周圍環境的理解能力,提高其在複雜道路條件下的導航和決策能力。

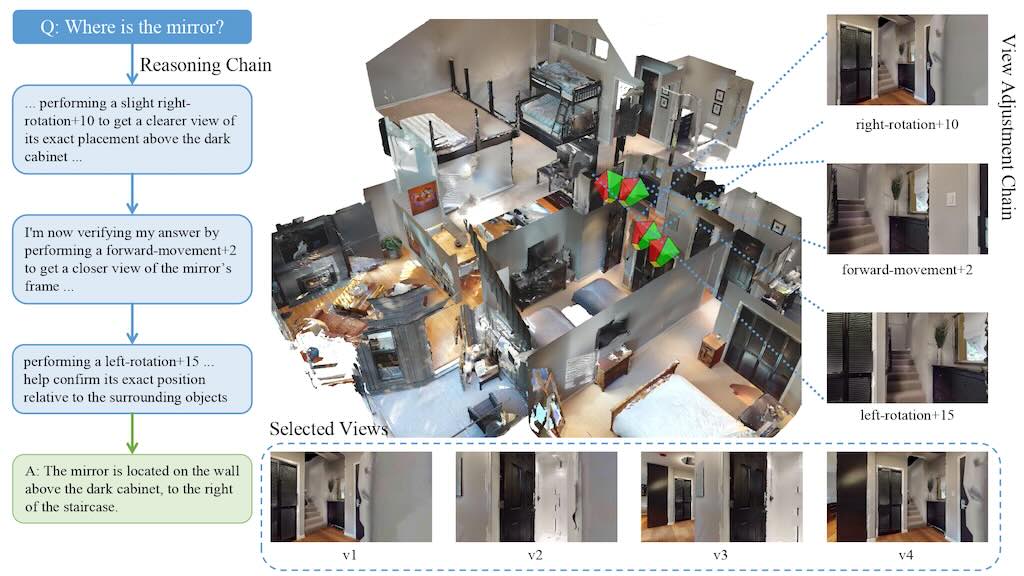

CoV 提出一種創新方法,專門針對在三維環境中的具身問答(Embodied Question Answering, EQA)問題。傳統的視覺語言模型(Vision-Language Models, VLMs)受限於固定的輸入視角,這使得它們在推理過程中無法動態地獲取與問題相關的上下文信息,進而限制了複雜空間推理的能力。CoV 通過引入一種免訓練、僅在測試階段運行的框架來解決這一問題,該框架能夠讓 VLMs 變成主動的視角推理器。